1 引 言

Markham等[3]研究发现,遥感影像空间分辨率的大小对分类精度影响存在两面性,即不是随着分辨率的增高分类精度会一味地提升。在进行遥感影像土地覆盖分类时, 精细的空间分辨率可减少边界的混合像元, 在一定程度上提高分类的精度;但过高的分辨率也会造成地物内部的光谱异质性增大, 从而降低分类精度 [4]。可见,满足高精度地物识别的最优影像空间分辨率是进行土地覆盖/利用遥感分类重点考虑的方面。Bian总结地理方差、局部方差、纹理分析和分形是研究尺度和分辨率之间的效应关系。Woodcock等[5]提出局部方差和Markowitz[6]提出的变异函数方法,是基于空间统计学中的空间依赖理论分析空间尺度对地物的表达效果。陈春雷等[7]利用中、高分辨率遥感影像进行了局部变异、变异函数的适用性和验证。在确定遥感影像空间分辨率对地物表达适应性能力方面,明冬萍等[1]提出了基于可变窗口与可变分辨率的改进局部方差方法,以局部方差为衡量标准来确定最优分辨率。韩鹏等[8]基于信息熵选择遥感分类的最优空间尺度,冯桂香等[9]采用Triangular Prism Method(TPM)、Double Blanket Method、TPM 3种分形维数确定影像的分辨率。以上方法利用不同的定量指标表达出遥感分辨率与目标地物尺度之间的关系,从地物类型尺寸、光谱异质性以及地物景观特征等方面确定出最优影像的空间分辨率。

其实,对于土地覆盖提取,最优分辨率的确定不但会受到影像尺度的影响,也受到分类器的影响。杨闫君等[10]在分析空间分辨率与纹理特征对多光谱遥感分类性能的影响中,总结Artificial Neural Network (ANN)相对于Support Vector Machine (SVM),Maximum Likelihood Classification (MLC)分类器的精度最高,确定实验区内多光谱特征的最优分辨率为5 m,加入纹理信息后,2 m分辨率下分类精度均有所提高。总结来看,遥感信息分析的最终目的是准确地提取出目标地物类型,而最优分辨率的确定受诸多因素的影响,如遥感影像特征(光谱特征、纹理)、分类器、区域景观和地物复杂性等因素,因此单靠光谱特征确定的最优分辨率难以在大区域上进行推广应用。

深度学习是近些年伴随并行计算和大样本标记样本学习的基础上发展起来的 [11]。相对于传统单层隐藏层的神经网络,它包括2个及以上隐藏层深层网络,设置不同级别的感受视野实现不同空间尺度的特征学习,进行信息的提取。深度卷积神经网络(Deep Convolution Neural Network,DCNN)是一种能够从图像上有效学习空间特性的网络,已经在大尺度遥感影像分类中取得了巨大的成功[12,13,14]。为充分学习像元周边的空间特征,通过设定核尺寸、层数和扩张因子3种方式灵活地学习像元周边空间特征的感受视野,确定周边空间范围对中心像元的影响,同时通过卷积、池化能够从底层形状特征向抽象特征的学习,提取地物量化的本质特征[15]。DCNN非监督特征学习,能够随着输入影像特性不断优化特征[16],这种具有弹性的特征学习方式能够适应遥感影像自身特点,更为重要一点是DCNN基于大量标记样本学习能够学习到广泛、鲁棒性强的地物特征,这一特性可以提高DCNN的泛化能力。

农作物在遥感影像上的表征受到地域、作物物候以及不同卫星数据源等方面的影响,表现出光谱差异强、农业景观特征复杂多样。已有研究表明,地物提取精度与影像空间分辨率有着内在关系,但DCNN能够多尺度非监督提取地物特征,这一特性是否可以克服遥感影像随空间分辨率提高光谱异质性增强的问题,值得进行研究。本文利用高分一号PMS,高分二号以及相应的融合影像进行冬小麦DCNN分类,分析不同空间分辨率对冬小麦分类精度的影响,探讨DCNN是否能够适应空间分辨率的变化而持续提高冬小麦的分类精度。

2 研究数据

2.1 研究区概况

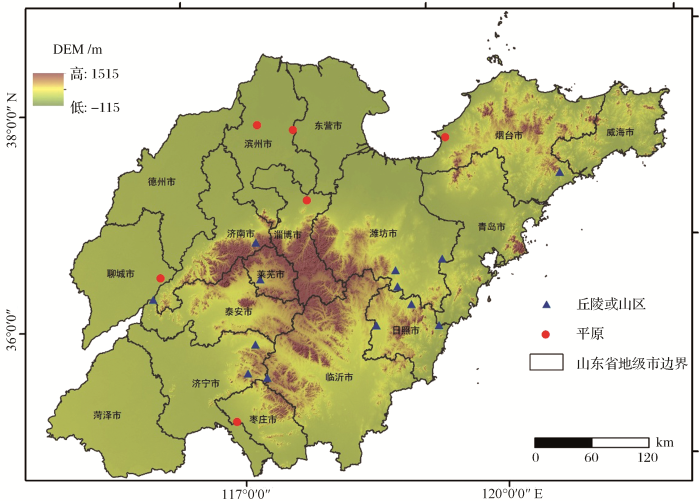

山东省位于34°22.9′~38°24.01′N, 114°47.5′~122°42.3′E,国土面积15.8万km2,占全国总面积的1.6%,与河北、河南、安徽和江苏等省毗邻。全省西部为黄淮海平原,中部为鲁中山区,山地、丘陵等复杂地貌约占全省面积的一半。山东的气候属暖温带季风气候,雨热同季,年平均降水量一般在550~950 mm之间,年均温11~14℃。山东省光照时数年均2 290~2 890 h,光照资源充足,热量条件可满足农作物一年两作的需要。粮食作物分夏、秋两季,其中小麦、玉米和地瓜是山东省三大主要粮食作物。本文根据冬小麦种植空间分布和地形地貌,选取了19个村开展DCNN冬小麦分类,分析影像空间分辨率对冬小麦分类精度的影响。19个村的分布如图1所示。

图1

2.2 数据及预处理

影像分辨率直接影响作物的分类精度,适当分辨率是保证分类精度的关键。本研究在冬小麦生长期内获取了19个村的高分一号多光谱(8 m)和全色影像(2 m)、高分二号多光谱(3.2 m)和全色影像(0.8 m)4个尺度的遥感影像。高分一号遥感影像获取时间为2017年1月下旬至2月下旬,高分二号获取时间为2017年6月上旬至中旬,均处于冬小麦生长季节内,适用于冬小麦遥感分类。由于19个村在全省分布离散(图2),每个村影像获取的具体时间不一致,跨度时间不较长,因此不再列出具体影像获取日期。

图2

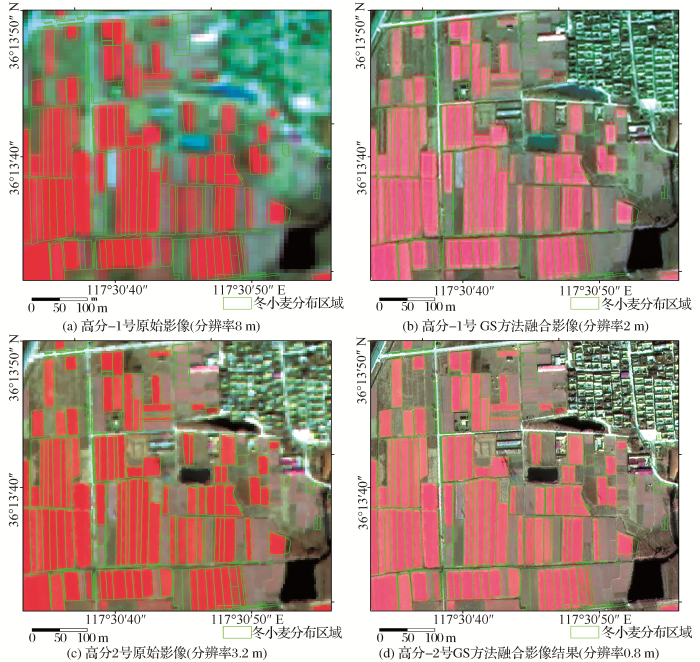

(1) 图像融合。图像融合既能继承多光谱影像的谱段特性,又能包含全色影像的空间特征,从而兼顾光谱、空间特性进行地物的提取。已有研究表明[17],Gram-Schmidt变换(GS变换)不仅能增加空间细节,又能较好的保持光谱信息,使图像具备更高的细节。因此,本实验采用GS变换对高分1号2 m和8 m、高分2号0.8 m和3.2 m两组影像进行融合,生成2 m和0.8 m的多光谱融合数据。

(2) 图像几何精校正。利用精校正的2米遥感影像为参照图,对高分一号及二号和相应的融合影像选择控制点进行图到图的几何精校正,投影坐标系为Albers-WGS84,两条标准纬线分别为25°N和47°N,中央经线为105°E。

(3) 标记样本构建。2017年5月开展了野外调查工作,在每个村随机布设5个200 m×200 m样方,利用GPS调查每个冬小麦地块的空间分布,共完成95个样方调查,用于高分遥感影像冬小麦地块的解译知识。大量标记样本是支撑PSPNet冬小麦遥感识别的基础,本文利用高分二号多光谱和全色融合生成的0.8 m遥感影像为底图,结合野外知识进行冬小麦目视解译,产生19个村精细的冬小麦地块,作为PSPNet训练的标记样本。

3 研究方法

3.1 网络设计

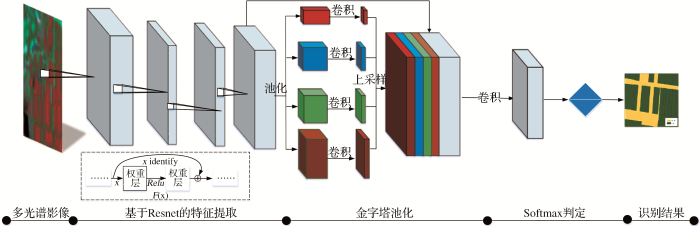

采用卷积神经网络进行冬小麦分类,提取出冬小麦的空间分布。金字塔场景分析网络(Pyramid Scence Parsing Network, PSPNet)[18]是一种综合多尺度场景的网络架构,该架构简单,分为卷积层、金字塔池化两个模块,其中卷积层的目的是实现从低层到高层特征的逐步抽象,金字塔池化是对卷积层模块最后一层抽象特征进行多尺度的池化与卷积,最后将多尺度池化/卷积特征进行上采样到卷积层最后一层尺度保持一致,进行二者的连接和卷积,然后反卷积与输入图像的尺度保持一致,判定每一个像元类型的归属,实现冬小麦的提取。PSPNet具有多方面优势,首先网络具有很好的灵活性,前半部分有效集成基础卷积层模块产生的特征,而卷积层模块可以采用不同的经典网络架构,如AlexNet[19],VGGNet[20],GoogleNet[21]和ResNet[22,23]等进行不同层级别的特征提取;其次,在金字塔池化层部分能够通过池化实现4个尺度的全局特征学习,提供优于像元场景解析的全局上下文关系,多个层次复合可以保持全局到局部的细节,得到更加丰富的地物间上下文特征。图2是利用PSPNet进行冬小麦识别的网络框架设计,主要是针对输入的多光谱影像进行ResNet学习,然后学习到的特征输入到金字塔池化模块进行多尺度的特征学习,最终将ResNet与多尺度池化/卷积特征进行联合,通过Softmax函数判定像元类型,得到冬小麦的空间分布。

为表达方便,对高分原始和融合影像进行命名,分别为高分二号GS融合影像(GF_2_GS,0.8 m)、高分一号GS融合影像(GF_1_GS,2 m)、高分二号多光谱影像(GF_2_MUL,3.2 m)和高分一号多光谱影像(GF_1_MUL,8 m)。利用PSPNet对4种尺度的影像进行冬小麦提取,分析不同尺度对分类结果的影响,从而解释DCNN对尺度的适应能力。

3.2 实验流程

针对多光谱和融合影像的4种尺度数据利用PSPNet进行训练,识别不同分辨率影像上的冬小麦。大量标记样本是进行PSPNet训练实现强泛化能力的基础,但建设大量样本需要投入大量的人力。迁移学习能够有效地从已有训练好的网络模型中迁移相应网络层的权重,要比“Scratch”随机方式确定的阈值更能够实现快速收敛,再利用少数的标记样本微调(Fine-tuning)训练模型,一定程度上消除“过拟合”问题[24]。根据研究组已经形成的全覆盖山东省米级土地覆盖数据,其分类体系包括农作物用地和其他用地类型,分割成500像素×500像素,样本量可达到20万多个,这能够满足PSPNet大样本训练的需求。利用该样本进行PSPNet训练,检验精度达到90%以上,形成预训练模型。针对本实验4个分辨率尺度的遥感影像数据集进行切割,随机选择15个村作为训练集合,剩余4个村用作检验和预测数据集。训练和检验单元为500像素×500像素的子区(Patch)。分类体系为:冬小麦、其他地物和背景。训练阶段利用PSPNet对上述4种影像进行迁移模型训练,SoftmaxWithLoss作为决策函数计算得分数与标记类型之间的Loss,采用反向网络(Back Propagation,BP)不断调整权重,让Loss逐步降低,直到Loss趋于稳定并达到预先设定的标准或者达到达到最高的循环次数。利用训练好的模型用于检验的4个村影像,通过Softmax函数将像元的得分数转换为地物的归属概率,实现对冬小麦类型归属的判定。

3.3 精度评价

4 结果分析

4.1 不同尺度的图像光谱特征分析

图3选取了高分一号、高分二号的一个子区影像和对应的GS融合影像。直观上看,GS融合影像的光谱信息较输入图像的差异比较大,这是融合过程中光谱信息损失的问题,但空间信息变得更为清晰。对于冬小麦,融合影像能够清晰的描述地块分布,地块边缘清晰,但对于高分一号影像地块边缘略微模糊,这是由于分辨率相对较粗(8 m)的缘故。

图3

图4

4.2 尺度对冬小麦识别精度的影响分析

为分析尺度变化对PSPNet与传统分类方法分类结果的影响,实验中利用支撑向量机(Support Vector Machine,SVM)对4个检验村进行分类。SVM是使用非线性映射算法将低维输入空间线性不可分的样本转化为高维特征空间使其线性可分,在结构风险最小化理论之上在特征空间中构建最优超平面,使得学习达到全局最优[26]。考虑到在4个分辨率尺度上应用SVM分类的适用性,在4个检验村选取样本的时候尽量位于尺寸较大的地物之内,然后采用二值SVM分类提取出冬小麦分布。表1是4个检验村冬小麦识别结果的精度评价,PSPNet在4个尺度上分类结果总体精度均超过了80%。其中,GF-2-GS总体精度最高,达到90%以上,随后依次是GF-1-GS、GF-2-MUL和GF-1_MUL,基本趋势是随着影像空间分辨率降低识别精度也随之降低。对于目标冬小麦而言,识别精度变化趋势也是一样的,GF-2-GS识别精度在4个尺度中是最高的,生产者精度为0.92,用户精度为0.86,F1-Score接近90%,而空间分辨率最低的GF-1-MUL冬小麦识别精度也是最低的。从4种尺度来看,随着分辨率的增高冬小麦识别精度逐步增高,二者基本同步,没有发现“最优分辨率”。GF-1-GS(2 m)虽然比GF-2-MUL(3.2 m)分辨率略高一些,但是二者分辨率仍较为接近,但GF-2-MUL更有丰富光谱优势,这是GF-2-MUL分类精度高的原因所在。在同一分辨率尺度上,PSPNet要优于SVM识别结果。对比分析分辨率对SVM的影响,GF-2-MUL识别出的冬小麦精度最高,其次是GF-2-GS、GF-1-GS和GF-1-MUL,这一结论与PSPNet分类得到的GF-2-GS最优有所不同。分析原因是,PSPNet是一种深度卷积神经网络,通过多层卷积学习能够学习获取到优化的光谱、纹理、上下文特征进行分类,而且大数量标记学习可以增强这一学习的泛化能力,这突破了只用光谱特征进行SVM分类的局限。从4.1节中分析得出融合影像会造成一定的光谱信息损失,增强了光谱的异质性,因此光谱明显、空间特征适中的3.2 m GF-2-MUL适合SVM分类,有利于冬小麦的提取。

表1 4种尺度冬小麦分类精度

Table1

| 生产精度/% | 用户精度/% | F1-Score | 总体精度 /% | ||

|---|---|---|---|---|---|

| PSPNet | GF-1-MUL | 0.80 | 0.88 | 0.84 | 83.57 |

| GF-1-GS | 0.84 | 0.89 | 0.86 | 85.26 | |

| GF-2-MUL | 0.90 | 0.85 | 0.87 | 89.12 | |

| GF-2-GS | 0.92 | 0.86 | 0.89 | 90.78 | |

| SVM | GF-1-MUL | 0.77 | 0.83 | 0.80 | 80.29 |

| GF-1-GS | 0.81 | 0.86 | 0.83 | 85.26 | |

| GF-2-MUL | 0.88 | 0.85 | 0.86 | 86.67 | |

| GF-2-GS | 0.88 | 0.83 | 0.85 | 84.35 |

4.3 子区图分析

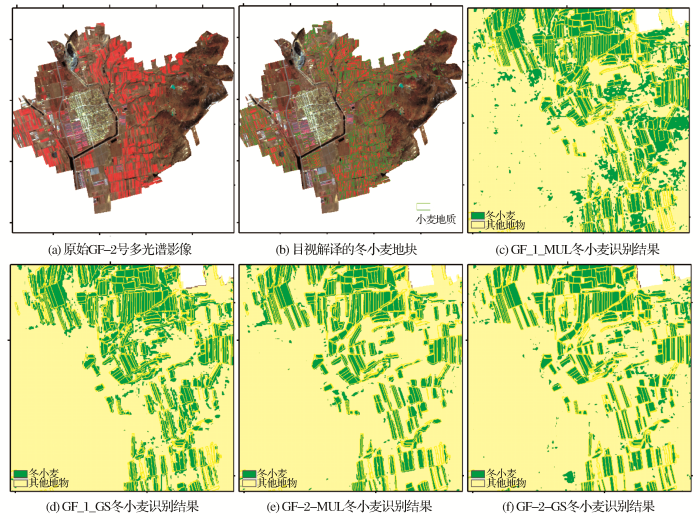

图5

图5

分辨率尺度冬小麦识别结果

Fig.5

Results of winter wheat identification for four remote sensing images

从识别的冬小麦地块来看,随着像元分辨率提高,冬小麦地块越来越精细。GF-1-MUL影像分辨率为8m,混合像元现象突出,一些其它地物易混入到冬小麦识别结果中,破碎的地块明显,这种混淆现象会随着分辨率的增高而一定程度上消除。GF-1-GS和GF-1-MUL两个影像的分辨率分别为2 m和3.2 m,二者识别的冬小麦地块比较接近。GF-2-GS在表达地块空间特征上最有优势,能够有利于地块精细的表达,保证细碎冬小麦地块的识别精度。可见,PSPNet能够有效地挖掘出冬小麦的空间特征,不受限于高分辨率光谱异质性的影响,保证冬小麦的识别精度。

5 讨 论

通过研究可以得到,对于深度卷积神经网络,影像分辨率仍然是影响分类精度的一个敏感因素。从8 m到0.8 m,随着影像分辨率的升高,图像表达地物的细节越来越精细。图5表明,即使影像上有与冬小麦相混的植被光谱,但随着分辨率的提高,PSPNet能够有效地利用影像的空间特征信息,通过空间特征可以准确地将冬小麦与其他光谱混淆的地物区分开,而低分辨率8 m空间信息不明显,造成光谱相混地物的混入。GF_1_GS和GF_2_MUL分辨率相近,虽然GF-2-MUL分辨率略粗,但GF-2-MUL原始光谱信息更为丰富,GF-1-GS存在光谱信息量的丢失。对于SVM分类方法,最优分辨率为3.2 m的GF_2_MUL,这与已有的研究结论是相同的 [10]。但PSPNet可以突破这一局限,分辨率越高会增强空间特征的表达从而提高保证分类精度,这拓展了已有的研究结论“分辨率过高光谱异质性增强,降低了地物的分类精度”[4],从而说明研究最优尺度的时候,要考虑到不同分类器特点,才能够得到更为符合实际应用的研究结论。

6 结 语

利用PSPNet深度卷积网络,实验分析了从8 m(高分一号多光谱,GF-1-MUL)、3.2 m(高分二号多光谱,GF-2-MUL)、2 m(GS融合多光谱:GF-1-MUL)和0.8 m(GS融合多光谱:GF-2-MUL)4个尺度影像进行冬小麦分类。从冬小麦识别结果可以得出,只要不断提高影像的空间分辨率,PSPNet能够充分地利用空间特征保证冬小麦的分类精度,消除分辨率增高造成光谱异质性的不足。这为利用PSPNet进行准确农作物信息提取最优分辨率的确定提供了实验支撑。

本研究影像分辨率是限定在米级分辨率开展的研究工作,下一步有待研究粗分辨率(如GF-1 WFV、Landsat OLI)、更细分辨率(航片)的两种尺度影像,分析卷积神经网络的尺寸以及感受野对不同分辨率影像识别地物的适应能力。

参考文献

Spatial Scale of Remote Sensing Image and Selection of Optimal Spatial Resolution

[J].

遥感影像空间尺度特性与最佳空间分辨率选择

[J].

Applying Spatial Statistics into Remote Sensing Pattern Recognition: with Case Study of Cropland Extraction based on GeOBIA

[J].

遥感模式分类中的空间统计学应用——以面向对象的遥感影像农田提取为例

[J].

Land Cover Classification Accuracy as a Function of Sensor Spatial Resolution

[C]

Remote Sensing Contributions to the Scale Issue

[J].

The Factor of Scale in Remote Sensing

[J].

Portfolio Selection-Efficient Diversification of Investments

[M].

Choice of Optimal Scale for Multi-source Remote Sensing Images

[J].

Selection of Optimal Scale in Remotely Sensed Image Classification

[J].

Fractal based Method on Selecting the Optimal Spatial Resolution for Remote Sensing Image

[J].

分形定量选择遥感影像最佳空间分辨率的方法与实验

Effects of Spatial Resolution and Texture Features on Multi-spectral Remote Sensing Classification

[J].

空间分辨率与纹理特征对多光谱遥感分类的影响

Deep Learning and Process Understanding for Data-Driven Earth System Science

[J].

Convolutional Neural Networks for Large-scale Remote Sensing Image Classification

[J].

Road Structure Refined CNN for Road Extraction in Aerial Image

[J].

Remotely Sensed Big Data Era and Intelligent Information Extraction

[J].

遥感大数据时代与智能信息提取

[J].

Complex Scene Classification of Remote Sensing Images based on CNN

[J].

基于CNN模型的遥感图像复杂场景分类

[J].

Object Detection based on Sparse Representation and Hough Voting for Sptical Remote Sensing Imagery

[J].

Response of Spatial Scale for Land Cover Classification of Remote Sensing

[J].

遥感土地覆被分类的空间尺度响应研究

[J].

Pyramid Scene Parsing Network

[C]

ImageNet Classification with Deep Convolutional Neural Networks

[C]

Very Deep Convolutional Networks for Large-Scale Image Recognition

[J].

Inception-v4, Inception-Resnet and the Impact of Residual Connections on Learning

[C]

Deep Residual Learning for Image Recognition

[C]

How Transferable are Features in Deep Neural Networks?

[C]

Crops Distribution Remote Sensing Extraction based on Decision Tree and Object-oriented Method

[J].

基于决策树和面向对象的作物分布信息遥感提取

[J].

Analysis and Evaluation of Method on Remote Sensing Date Fusion

[J].

遥感数据融合方法分析与评价综述

[J].

Aircraft Auto-detection in Domestic High Resolution Remote Sensing Images Using Deep-learning

[J].

基于深度学习的国产高分遥感影像飞机目标自动检测

[J].