集成U-Net方法的无人机影像胡杨树冠提取和计数

李越帅 , 1 , 2 , 郑宏伟 , 1 , 2 , 罗格平 1 , 2 , 杨辽 1 , 王伟胜 1 , 桂东伟 1

1.中国科学院新疆生态与地理研究所 荒漠与绿洲国家重点实验室,新疆 乌鲁木齐 830011

2.中国科学院大学,北京 100049

Extraction and Counting of Populus Euphratica Crown Using UAV Images Integrated with U-Net Method

Li Yueshuai , 1 , 2 , Zheng Hongwei , 1 , 2 , Luo Geping 1 , 2 , Yang Liao 1 , Wang Weisheng 1 , Gui Dongwei 1

1.State Key Laboratory of Desert and Oasis Ecology,Xinjiang Istitute of Ecology and Geography,Chinese Academy of Sciences,Urumqi 830011,China

2.University of Chinese Academy of Sciences,Beijing 100049,China

通讯作者: 郑宏伟(1972-),男,山东潍坊人,博士,研究员,主要从事计算机视觉,定量遥感和机器学习研究。E⁃mail:hzheng@ms.xjb.ac.cn 。

收稿日期: 2018-12-06

修回日期: 2019-09-21

基金资助:

国家重点研发计划“一带”核心区域生态环境安全监测与应急响应示范 . 2017YFB0504204 中国科学院特色研究所主要服务项目 . TSS⁃2015⁃014⁃FW⁃1⁃3 国家自然基金面上项目 . 41877012

Received: 2018-12-06

Revised: 2019-09-21

摘要

塔里木河流域的胡杨林是该荒漠区域典型的森林资源,胡杨树冠大小和株数信息对塔里木河流域森林资源监测、生态保护和恢复具有重要意义。由于该流域乔灌草植物群落分布的复杂性,传统方法很难实现胡杨树冠的精准分割和大范围的株数提取。以塔里木河中游胡杨林为研究区,选取几块典型胡杨林区域,提出集成深度学习和分水岭分割的处理方法,对密集胡杨树冠的精准分割和单株胡杨的提取进行了深入探讨。首先,将无人机影像(空间分辨率0.16 m)无缝拼接生成正射影像;采用U-Net卷积神经网络对胡杨树冠覆盖区域进行精准分割;在U-Net模型分割的基础上使用标记分水岭方法对密集胡杨树冠进行自动再分割和单株计数,计算出所选研究区的胡杨株数并精准定位。结果表明U-Net卷积神经网络对胡杨的所有树冠区域提取的平均精度可达94.1%,在胡杨树冠覆盖区域识别分割的基础上,用标记分水岭分割方法对胡杨单木计算总体精度为93.3%。研究认为,结合深度学习和标记分水岭方法为自动化大范围森林资源监测提供了新思路和借鉴经验。

关键词:

无人机影像 胡杨 深度学习 分水岭 树冠 株数

Abstract

The Populus euphratica forest in the Tarim River Basin is a typical forest resource in the desert area. The canopy size and plant number information of Populus euphratica is of great significance for forest resource monitoring, ecological protection and restoration in the Tarim River Basin. Due to the complexity of the distribution of arbor, shrub and grass communities in the area, it is difficult to achieve accurate segmentation of canopy in dense Populus euphratica and large-scale plant number extraction. Taking the Populus euphratica forest in the middle of Tarim River as the research area, several typical Populus euphratica forest areas were selected, and the integrated processing methods of fusion deep learning and watershed segmentation were proposed. The precise segmentation of dense Populus euphratica and the extraction of Populus euphratica were carefully discussed in depth. First, the drone images (spatial resolution 0.16 m) are seamlessly stitched together to generate an orthophoto. Then U-Net convolutional neural network was used to accurately segment the canopy cover area of Populus euphratica. Furthermore, the marker segmentation method was used to automatically re-segment and count the intensive Populus canopy, and the number of Populus euphratica in the selected study area was calculated and accurately positioned. The results show that the average accuracy of the extraction of all canopy regions of Populus euphratica by integrated U-Net convolutional neural network is up to 94.1%. The overall accuracy of the calculation of Populus euphratica by the marker watershed segmentation method is 93.3%. The study suggests that the combination of deep learning and marker watershed methods can provide new ideas and lessons for the automation of large-scale forest resource monitoring.

Keywords:

UAV image Populus euphratica Deep learning Watershed Tree crown Tree counting

本文引用格式

李越帅, 郑宏伟, 罗格平, 杨辽, 王伟胜, 桂东伟. 集成U-Net方法的无人机影像胡杨树冠提取和计数 . 遥感技术与应用 [J], 2019, 34(5): 939-949 doi:10.11873/j.issn.1004-0323.2019.5.0939

Li Yueshuai, Zheng Hongwei, Luo Geping, Yang Liao, Wang Weisheng, Gui Dongwei. Extraction and Counting of Populus Euphratica Crown Using UAV Images Integrated with U-Net Method . Remote Sensing Technology and Application

1 引 言

塔里木河流域胡杨林(populus euphratica forest)是该荒漠生态系统的重要组成部分,维系着荒漠区域能量与物质的循环[1 ] 。胡杨树冠的覆盖度、株数等信息是指导森林经营管理的重要指标,因此提取胡杨树冠的覆盖范围和株数等信息对塔里木河流域森林资源监测保护具有重要意义[2 -3 ] 。

随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案。然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] 。另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] 。当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] 。在这些研究中,大多数学者多采用一至两种方法提取树冠。然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道。

塔里木河流域胡杨空间分布极其不均,生长状态变化多样,其树冠光谱反射率无恒定阈值,且与周围柽柳、梭梭等绿色植被并存生长,这些客观因素都会对胡杨树冠提取的精度造成很大的影响[18 ] ,所以传统方法很难直接应用于该流域树冠提取和株数计算[19 ] 。针对以上问题,首次提出了集成U-Net卷积神经网络和标记分水岭方法,先进行胡杨树冠覆盖区域的识别分割,再将分割后的密集区进行单株胡杨分割计数。其计算流程主要包括以下两步:①通过U-Net卷积神经网络对无人机影像数据处理实现初次分割,获取胡杨树冠的精准边界范围;②在提取树冠边界的基础上,采用改进的标记分水岭方法对密集区域树冠进行二次分割,实现单木树冠分割并计数。

2 研究区和数据

2.1 研究区概况

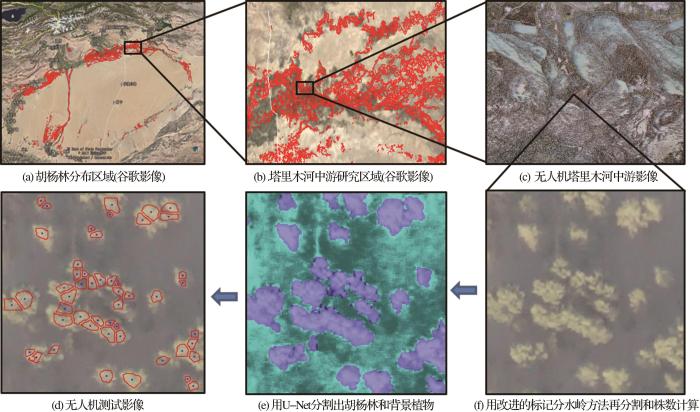

研究区为塔里木河中游部分(图1 ),该区属典型的大陆性暖温带荒漠干旱气候,该区蒸发强烈,高温少雨。主要以杨柳科、柽柳科和夹竹桃科等植物为主,构成了乔木、灌木和草本等伴生植物群落。塔里木河两岸的胡杨林是干旱荒漠地区唯一森林资源,对绿化荒漠起着非常重要的作用,也是维系塔里木河流域生态系统稳定的唯一树种,胡杨树冠及株数的精准识别与检测对保护塔里木河流域胡杨及其生态系统具有重要意义[20 ] 。

图1

图1

研究区及处理流程示意图

Fig.1

Research area and processing flow diagram

2.2 数据介绍

本研究主要使用无人机影像作为数据源(QC-1型固定翼电动无人机),该无人机使用SONY DSC-RX1RM2相机,4 000万像素,等效焦距为35 mm。拍摄时间是2017年8月19至8月30号,航向重叠为80%,旁向重叠为60%,空间分辨率为0.16 m,波段为可见光波段 (RGB)。将所选研究区的298景无人机影像、POS数据及像控点输入Pix4D软件,进行无缝拼接生成正射影像。

通常情况下使用传统感兴趣区制作样本方法并不能最大限度的发挥深度学习的优势,所以首先需要将整个所选择的样本区域做标签分类。其次,为了提高胡杨覆盖面的识别精度,训练样本综合考虑了异物同谱、同物异谱、异龄同群及树木阴影等现象,样本尽可能多地涵盖全部胡杨树冠类型,最终选择16个有代表性500×500像素的区域作为训练集。此外,无人机影像可以清晰地分辨胡杨树冠的形状轮廓,可以根据目视解译将胡杨树冠范围勾绘出来作为标签数据,以及验证和测试数据。

3 研究方法

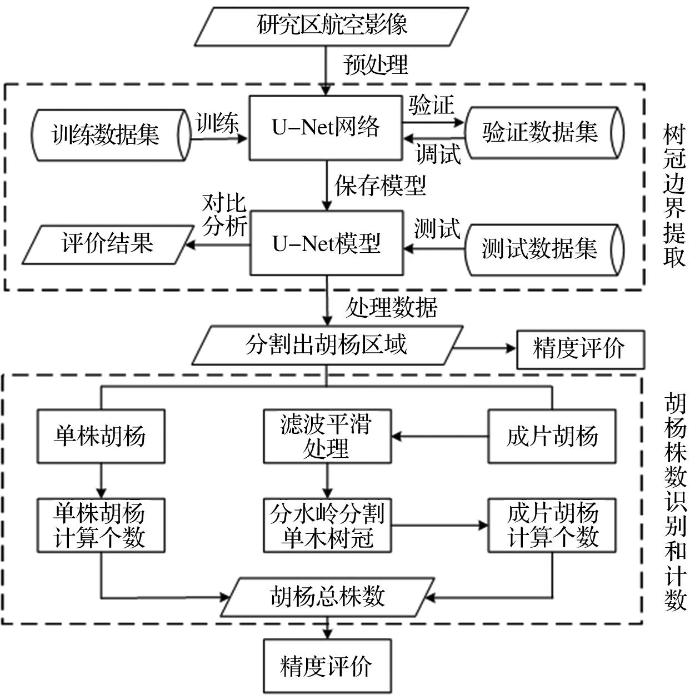

本研究集成U-Net深度学习和标记分水岭方法,实现一个自动化计算流程,可对大范围的胡杨识别和计数。首先利用U-Net模型把胡杨树冠从复杂背景中识别和分割出来;然后使用滤波处理方法对胡杨区域进行纹理特征、灰度特征和形状等图像特征放大;再次利用标记分水岭方法对分割出来的密集区域进行单木树冠分割并计算株数,从而最大限度地提高单株胡杨的识别和计数精度。

首先简述U-Net卷积神经网络模型结构及其在无人机影像分割方面的优点,其次详细介绍本实验所使用的U-Net卷积神经网络模型的具体参数及设置,最后简述基于形态学滤波处理的标记分水岭算法的原理。

图2

图2

树冠分割提取和株数计算流程图

Fig.2

Flow chart of the tree crown segmentation andextraction and the counting of tree numbers

3.1 树冠边界提取

3.1.1 U-Net卷积神经网络模型结构

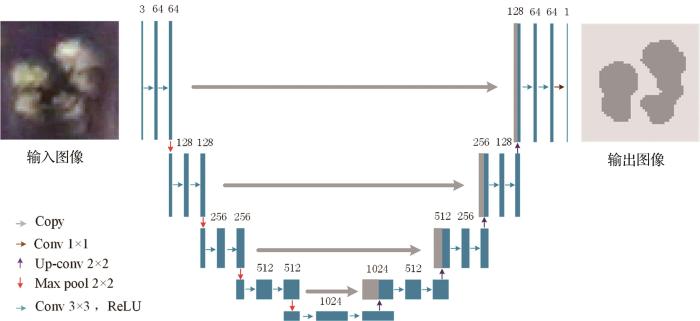

传统的深度学习方法如卷积神经网络模型(Convolutional Neural Networks,CNN)的池化层通过多次卷积逐步降低了图像分辨率,丢失了特征空间信息,无法将遥感影像目标的边界精准勾画出来。鉴于此,来自伯克利的Long等[21 ] 使用全卷积网络(Fully Convolutional Network,FCN)模型改进了经典的CNN模型,对CNN最后一个卷积层的特征图进行反卷积处理,将特征图尺寸恢复至与原始图像分辨率一致的输出层[22 ] ,保留了空间位置信息,并且可以实现了图像的像素级分类。FCN生成最后的特征图之前经历了多次池化处理,导致许多图像细节丢失,得到的分割结果往往过于平滑,原始图像很多细节无法还原,从而无法精确地提取目标轮廓[23 ] 。针对FCN的不足,U-Net模型对FCN端对端的思想进行了扩展和延伸,采用编码器-解码器结构建立快捷连接,帮助解码器更好地修复目标的细节,并且尽可能地保真和还原原始图像的空间信息,从而最大限度地保留了深度学习方法中训练集的原始特征如分割对象的边缘特征、纹理特征和形状特征等。

3.1.2 U-Net模型参数

在U-Net网络模型基础上,输入拼接和校正后的无人机正射影像,对胡杨树冠覆盖区域进行识别和分割。在传统的CNN模型中,训练深度学习一般需要大量的带标注的训练样本。在U-Net网络模型中,采用数据增强方法可以高效地利用训练样本,仅采用16幅500×500像素小样本图片作为训练集,可做到端到端的逐像素分割。使用随机位移矢量的方法使样本产生弹性形变,增加样本特征,弥补样本不足的缺点,输入训练网络可以更高效地提取有效特征,从而达到精准地分割和识别。

U-Net网络设计是通过采用多次对图像的收缩(左边)和扩张(右边)构成对称结构[6 ] ,进行特征学习和建立特征训练库,其中收缩和扩张次数取决于实现图像金字塔多分辨率结构中下采样和上采样的级数(图3 )。该网络遵循典型的卷积网络结构,每进行一次收缩,需要经历两次卷积和一次下采样操作,由于训练采用500×500像素的小样本图片,收缩次数过多会导致图片尺寸过小、维度过高,不适合训练特征,收缩次数太少则无法学习到更高维特征,综合考虑测试设置4层收缩网络较为合适。每次卷积步骤均使用3×3卷积核(stride =1,padding =1)和修正线性单元(rectified linear unit,ReLU)激活函数组成,然后进行2×2最大池化(stride =2,padding =0)步骤完成一次下采样。同样在扩张路径中每次卷积操作之前,通过矩阵级联的方式与收缩路径中对应层的高分辨率特征进行融合,卷积层可以基于融合的信息学习更加精准的特征输出,从而更好地修复目标细节,提高分割精度。

图3

图3

U-Net结构框架

(蓝色条框代表多通道特征;灰色条框代表复制多通道特征;条框顶部数字代表通道数目;箭头代表不同的操作)

Fig.3

The architecture of U-Net

学习率(Leaning Rate)是一个控制网络权重的超参数,它的大小可以控制网络模型收敛的速度,并且防止梯度失控或者过拟合。通过反复测试调节设置初始学习率为0.05开始训练,并使用L2范数根据训练的次数来控制学习率的渐变。使用padding填充边界,卷积后的输出图像具有和原图像相同大小的分辨率,这样既保存了分割的准确性,又保留了重要的空间位置信息。

3.1.3 U-Net模型分割结果评价指标

对于分类精度评价常见的有以下指标:计算总体精度(Overall Accuracy,OA)、召回率(Recall)、交并比(Intersection over Union,IoU)和Kappa系数,其公式计算如下:

O A = T P + T N T P + F P + F N + T N (1)

R e c a l l = T P T P + F N (2)

I o U = T P T P + F P + F N (3)

其中:TP表示正确检测的相元个数,FP表示错误检测的相元个数,FN表示遗漏检测的相元个数,TN表示无关检测的相元个数,这几种参数可以比较全面地表达分割结果的好坏程度。

3.2 胡杨株数识别和计数

3.2.1 基于形态学的滤波处理

由于胡杨属于阔叶林,不同于针叶林只存在一个极值点,胡杨树冠会存在很多局部最大值,直接使用标准的分水岭方法很容易将这些局部极值检测出来造成过分割现象。为了消除过多的局部极值和噪声的影响,在运用传统分水岭算法[24 ] 之前,需要对分割后的密集区胡杨树冠图像做形态学开运算处理,形态学的开运算实质上是先腐蚀后膨胀的过程。利用灰度级形态学开运算进行滤波重建,在保证平滑图像的同时又消除了过多的噪声,同时最大限度地保留和提高了被分割对象的有效图像特征,减少了分割不足和过分割的情况。

给定一副图像中感兴趣特性所使用的小集合或者子图像记为结构元b ,当b 的原点位于(x,y )处时,腐蚀运算的定义为图像ƒ 中与b 重合区域的最小值[25 ] 。结构元b 对一副图像ƒ 在位置(x,y )处的腐蚀定义公式如下:

f ⊝ b x , y = m i n s ∈ b x + s , y + s (4)

其中:⊝ x,y )表示b 的原点在灰度级图像的位置,s 表示结构元的尺寸并决定了形态特征变换形式。采用类似方式,腐蚀算法定义如公式(5)所示:

f ⨁ b x , y = m i n s ∈ b x - s , y - s (5)

其中:⨁

f ○ b = f ⊝ b ⨁ b (6)

在公式(6)中○

3.2.2 分水岭算法标记分割

分水岭分割算法是根据形态学思想,将图像模拟成一幅高低起伏的地形,像元值的大小代表地形图海拔的高低,局部极小值区域称为集水盆,假设水慢慢浸入并且开始淹没表面时,在不同的汇水盆区域建造大坝防止其汇合,这个修建起来的大坝就形成了分水岭[26 ] 。观察密集区胡杨树冠,相互重叠在一起的胡杨树冠会形成明暗不同的类似分水岭的交界线,因此可运用分水岭方法进行密集区树冠分割。

分水岭算法主要目的是为了分割出单木树冠的连通区域,使用3×3大小的矩阵,探测滤波处理后密集区域树冠的局部最大值作为标注,可减少伪树冠顶点的干扰。经反复测试和研究,基于标注点使用8连通邻域扩散可获得较好树冠分割效果,使用MATLAB编程实现标记分水岭方法对密集区胡杨树冠的分割。

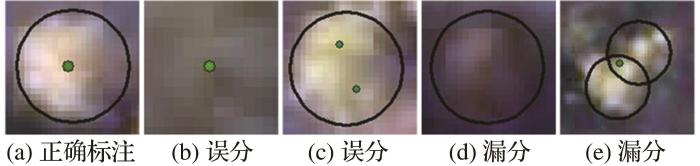

3.2.3 基于分水岭算法的株数提取结果评价指标

运用分水岭算法提取胡杨株数,采用总体精度(Overall Accuracy,OA)、误授误差(Commission Error,CE)、漏分误差(Omissions Error,OE)和准确率(Accuracy Rate,AR)作为精度评价标准。此处总体精度定义与前面树冠提取总体精度有所不同,公式如下:

O A = 1 - N d - N v / N v × 100 % (7)

C E = N c / N v × 100 % (8)

O E = N o / N v × 100 % (9)

A R = 1 - C E × 100 % (10)

其中:N d N v N c N o

结合胡杨树冠范围大小的真实测量值,确定以样本树冠中心点1.6 m缓冲区范围内所探测到的点为正确探测点。经测试会出现图4 中情况,精度验证时,图4 (c)和4 (e)情况分别作为一个正确分类和一个错误分类处理。

图4

图4

树冠中心点检测出现的几种情况

Fig.4

Different cases of crown center detection

4 结果分析

4.1 U-Net模型的训练及分割结果

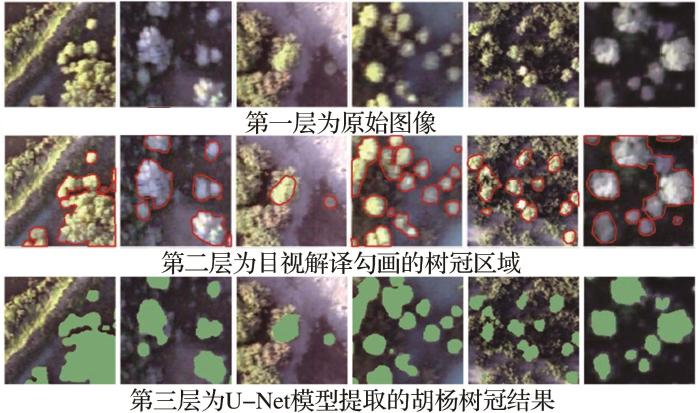

将训练集和验证集一并输入网络,训练集主要用于训练特征,验证集用于寻找最优的网络模型。训练结果截取部分如图5 所示,通过对比目视解译结果看出,测试结果较为精准地分割出胡杨树冠,并且在解决以下传统难点方面有显著的效果。

图5

图5

胡杨树冠分割结果

Fig.5

Segmentation results of Populus euphratica crown

(1)同物异谱:由于胡杨自身生长状态及拍摄日期和拍摄角度的不同,造成胡杨树冠反射率差别较大。如图5 (b)、(d)、(f)可看出不同反射率的胡杨树冠依旧得到较为精准的提取。

(2)异物同谱:由于无人机数据只有可见光波段,柽柳和梭梭等绿色植被反射率与大部分胡杨树冠反射率非常相似。通过卷积获得样本数据的高维特征,U-Net模型可有效地利用空间和纹理等特点区分胡杨和其他地表植被,如图5 (a)、(c)、(e) 所示。

(3)提取阴影处目标:胡杨树冠大小不一,重叠遮挡现象很普遍,传统方法难以有效地区分。图5 (d)和5 (f)中部分被遮挡的树冠依然可以精准地识别。

4.2 U-Net模型对树冠覆盖区域提取精度分析

本实验通过对比U-Net模型、支持向量机(Support Vector Machine,SVM)和面向对象(Object Oriented,OO) 3种识别和分割方法,证明了U-Net在胡杨覆盖面的分割和识别表现优于其他方法,平均总体精度达到94.1%,实验证明该模型可较为精准地提取胡杨树冠。图6 是使用3种方法对4个测试区域的树冠提取结果比较图。图中可以直观地看出U-Net误检区域明显小于其他两种方法显示的结果,面向对象误检区域较多,主要是因为误检区域地表绿色植被的影响。面向对象模型需要构建复杂的分类特征,并且不同的分割尺度对结果影响非常大,这个特性也说明面向对象方法的人为误差会比较大。U-Net方法的漏分区域同样明显低于面向对象方法,略微小于SVM方法,产生漏检区域主要是树冠反射率异常和样本量偏小导致。

图6

图6

不同方法的树冠提取结果比较

Fig.6

Comparison of crown extraction results using different methods

本实验采用疏密程度不同的4个区域证明模型的精度。树冠比较密集的区域地表植被及树冠长势都比较旺盛,为精准提取树冠增加了难度,相反稀疏区胡杨及地表植被也较稀疏,提取难度相对较低。如图6 所示,基于U-Net模型对稀疏和密集区域胡杨树冠覆盖面的提取效果差别不大,区域a和b比较密集,提取平均总体精度为93.0%,区域c和d比较稀疏,平均总体精度为95.2%,说明该模型在稀疏区和密集区均适用,有较好的精度和鲁棒性。

表1 中记录了3种分割方法的精度,综合4项精度评价指标可以直观地看出,U-Net模型对胡杨树冠覆盖面的分割精度明显高于其他两种模型。U-Net模型对4个试验区的总体分类精度平均可达94.1%,并且Kappa系数平均在0.85以上,说明此模型对胡杨树冠分割精度较高。从表格数据看U-Net模型分类效果相对于传统方法有明显的提升。U-Net模型平均总体精度高于SVM模型3.5%,高于面向对象7%。基于U-Net模型的Kappa系数相较SVM和面向对象分别提升8.7%和19.2%,最高达到88.7%。

综上所述,U-Net模型分割精度高,一定程度上可以代替人工目视解译结果,大大地提高工作效率。该模型的适用性较强,扩大不同类型胡杨训练样本集可以进一步提高分类精度,使用批量处理技术可对大范围胡杨林进行自动化分割作业。U-Net模型不仅克服了传统方法需要手工选择样本特征的缺点,而且还具有较强的适用性和可扩展性,能为下一步标记分水岭方法的二次分割精度提供保障。

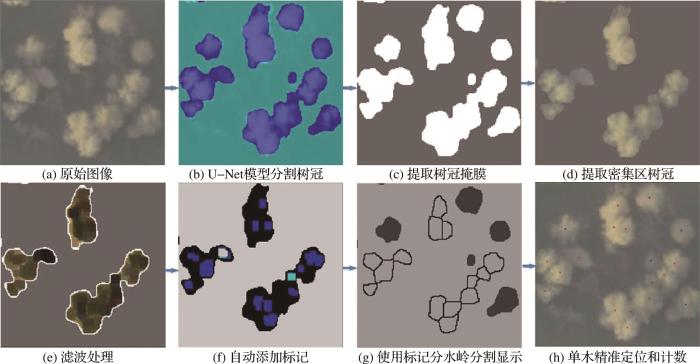

4.3 基于标记分水岭对单株胡杨的再识别和计数

首先根据提取的胡杨树冠面积大小分为稀疏区和密集区。统计单独的胡杨树冠面积可知,胡杨单木树冠面积大多数处于800个像素以下,即单木胡杨树冠面积大部分小于20 m2 ,所以将胡杨树冠小于800像素的区域当做稀疏区,反之作为密集区。每个稀疏区胡杨冠层区域即为一个单木胡杨树冠,并且标注其质心作为树冠中心位置,然后将密集区进行标记分水岭分割,具体处理过程如图7 所示。

图7

图7

实验步骤(红色点表示密集区单木位置,绿色点表示稀疏区单木位置)

Fig.7

The computing workflow of our proposed watershed segmentation method

在进行分水岭之前需将数据做平滑滤波处理,此步骤是保证密集区胡杨树冠提取精度的关键所在。图7 (d)为提取的密集区树冠,首先进行边缘增强滤波处理,如图7 (e)所示,边缘滤波可以凸显树冠与树冠重叠之处的边界信息,便于分割单木树冠。为了提高分水岭算法的精度,首先对分割后的胡杨树冠做图像形态学开运算处理。图像形态学的开运算可以增强主要特征,去除噪声得到相邻均值,减少因噪声干扰造成的分水线位置偏移和因局部极值过多造成的分水岭过分割现象,结合原始图像的纹理特征、灰度值以及色彩特征对胡杨树冠进行再分割以达到最好的效果。进行开运算需要设置结构元尺寸,其大小会直接影响开运算结果,需要通过控制结构元的尺寸来调节开运算的平滑尺度。为了研究最佳的结构元尺寸,随机选取10个300×300像素(50 m×50 m)的样方,通过目视解译作为验证数据,分别采用结构元尺寸为4、5、6、7、8、9进行开运算,具体计算结果见表2 。

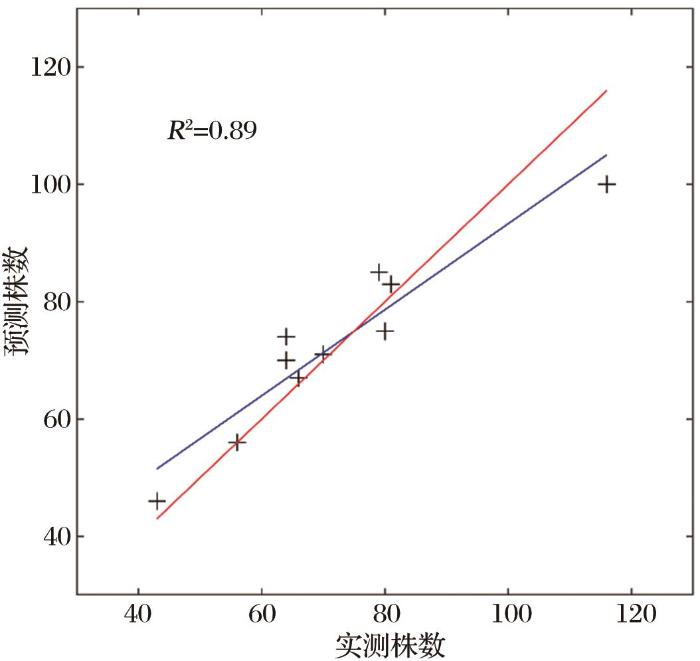

从表2 数据观察可知,结构元尺寸的大小跟提取出来的株数成反比。因为,结构元尺寸越大,对图像平滑尺度越大,更多的特征点被周围相元“同化”,得到的结果就会偏小,造成漏分割现象;相反,结构元尺寸越小,保留的特征点越多,使用分水岭算法就会得到更多的株数,造成过分割现象。所以,为了寻找最合适的分割尺度,将结果分别做线性回归拟合(图8 ),实验证明结构元尺寸为6的时候R 2 取得最大值0.89,表明此时可以取得最佳分割效果,图8 中绿色的线是使用结构元尺寸为6的测试结果。Crowther等[2 ] 在计算全球树木株数时候R 2 高达0.97,因为本研究验证样方数量少,并且选择的样方区域大小相同,最终株数大多聚集在60~80之间,影响了拟合结果;选择不同面积的样方计算出的株数值会产生离散效果,进行拟合会更加接近1∶1标准线,可以提高拟合精度。

图8

图8

预测最佳拟合直线(蓝线)与实测直线(红线)关系

Fig.8

The relationship image between the best prediction fitting line(red)and measured straight line (green)

4.4 分水岭分割密集区单木树冠的精度分析

基于上一步分割得到的密集胡杨区域,利用平滑处理后的图像特征,使用标记分水岭方法可以将密集的胡杨林分割成单株的胡杨,从而自动计数。本实验使用结构元尺寸为6的开运算处理后对上述10个样方进行标记分水岭方法分类,精度验证结果如表3 所示。总体精度高达到98.63%,总体误授误差为14.81%,总体漏分误差为13.44%。平均总体精度为93.29%,较总体精度相差5.34%,分析可知是因为提取株数在实测株数值左右浮动,将10个提取株数样本求总数正好和实测株数值相差很小,所以根据总体计算公式求得总体精度较高,使用平均总体精度93.29%可以更加准确的表达分类精度。何艺等[27 ] 使用多尺度分割算法对阔叶林样地株数提取总体精度达到90.34%,本研究总体精度为93.29%,精度提高了2.95%。郭昱杉等[26 ] 单独使用标记分水岭方法进行阔叶林单木树冠提取,准确率为65.55%,本研究通过深度学习进行初步分割,再使用标记分水岭分割,平均准确率达到84.75%,提高了19.2%,说明融合集成应用U-Net深度学习和分水岭分割的方法比单独使用标记分水岭分割有更好的精度。

表3 中样地1的漏分误差高达25%,主要原因有两个:第一是因为该区域处于阴影处的单株胡杨较多,阴影处的树冠和阴影裸地的反射率非常接近造成深度学习算法漏检,最后导致整体株数漏分误差较大;第二是因为存在两棵树冠连在一起的情况,两株胡杨树冠面积范围小于800像素值会被算法当做一株胡杨来计算,即出现图4 (e)漏分情况。通过加大阴影处胡杨树冠的样本是最有效果地解决阴影树冠漏分情况出现的方法,其次也可以通过调节稀疏区树冠最大定义面积来避免第二种漏分情况,但是此方法有可能将单株冠层较大的胡杨识别为多株造成过分割,可能导致误授误差的增大。

表3 中样地6的误授误差最大,达到21.6%。观察可知该样方区域树冠过于密集,局部极值点过多造成误差。误授误差还可能是因为对胡杨冠层中心的检测的不准确,造成检测点处于缓冲区之外(此种情况检测点也在胡杨树冠上,只是稍微偏离树冠中心),这种情况主要原因是树冠本身反射率最大值可能在树冠边缘地区,而目视解译则默认标注树冠中心点,因此造成误授误差。其次,是因为胡杨属于阔叶林,阔叶林树冠中心点不明确,并且胡杨树冠形态多样,很可能一棵树存在多个冠层,此时算法可能将识别为多株胡杨。太阳照射角度的问题,也可能引起冠层边缘反射率出现异常,导致算法误将边缘当做树冠中心进行标注而造成误授误差。

5 结 语

针对密集胡杨分布区域统计难和单株计数难的问题,本研究尝试采用集成U-Net深度学习和分水岭分割的方法,有效地减少了传统方法难以区分的地表绿色植被的影响,实现密集区域单株胡杨冠层的精准提取和株数的精准计算,分别获得了94.1%和93.29%的平均总体精度。自动化程度高,克服了传统方法分割精度低、目视解译工作量繁重等弊端,为探索人工智能技术在林业资源调查中的应用提供了一条新途径,为大范围林业调查、推动精准林业的发展提供借鉴经验。

相对于传统的机器学习方法如SVM分类方法和传统的深度学习CNN等单一的分类识别方法,本实验方法具有以下优点:①集成U-Net深度学习方法分割树冠覆盖范围,然后使用分水岭做二次单株胡杨检测和分割,提高树冠和株数计算的准确性;②选取代表性的区域,使用小样本训练集替代传统深度学习的大训练集,得到较高精度的胡杨树冠提取和单株计数。下一步,本研究将从以下两个方面进行改进和扩展:①增加其他地物(灌木、荒漠和水域等)的分类,统筹分析胡杨生长状态的驱动因素;②以整个塔里木河流域作为研究区,全局掌握胡杨林的生长和分布情况,为大范围的塔里木河流森林监测和保护提出合理性的建议。

参考文献

View Option

[1]

Chen Yaning Hao Xingming Li Weihong et al An Analysis of the Ecological Securityand Ecological Water Requirements in the Inland River of Arid Region

[J].Advances in Earth Science ,2008 ,23 (7 ):732 -738 .

[本文引用: 1]

陈亚宁 ,郝兴明 ,李卫红 ,等 干旱区内陆河流域的生态安全与生态需水量研究

[J].地球科学进展 ,2008 ,23 (7 ):732 -738 .

[本文引用: 1]

[2]

Crowther T W Glick H B Covey K R et al Mapping Tree Density at a Global Scale

[J].Nature ,2015 , 525 (7568 ):201 -205 .

[本文引用: 2]

[3]

Qin Xianlin Li Zengyuan Yi Haoruo Extraction Method of Tree Crown Using High-resolution Satellite Image

[J].Remote Sensing Technology and Application ,2005 ,20 (2 ):228 -232 .

[本文引用: 1]

覃先林 ,李增元 ,易浩若 高空间分辨率卫星遥感影像树冠信息提取方法研究

[J].遥感技术与应用 ,2005 ,20 (2 ):17 -21 .

[本文引用: 1]

[4]

Krizhevsky A Sutskever I Hinton G E ImageNet Classification with Deep Convolutional Neural Networks

[J].International Conference on Neural Information Processing Systems ,2012 ,60 (2 ):1097 -1105 .

[本文引用: 1]

[5]

Li W Fu H Yu L et al Deep Learning based Oil Palm Tree Detection and Counting for High-resolution Remote Sensing Images

[J].Remote Sensing ,2016 ,9 (1 ):22 -33 .

[本文引用: 1]

[6]

Ronneberger O Fischer P Brox T U-Net:Convolutional Networks for Biomedical Image Segmentation

[C] //Medical Image Computing and Computer-Assisted Intervention —MICCAI ,Munich ,2015 .

[本文引用: 2]

[7]

Hu Jianbo Zhang Jian Unmanned Aerial Vehicle Remote Sensing in Ecology:Advances and Prospects

[J].Acta Ecologica Sinica ,2018 ,38 (1 ):20 -30 .

[本文引用: 1]

胡健波 ,张健 无人机遥感在生态学中的应用进展

[J].生态学报 ,2018 ,38 (1 ):20 -30 .

[本文引用: 1]

[8]

Li Deren Li Ming Research Advance and Application Prospect of Unmanned Aerial Vehicle Remote Sensing System

[J].Geomatics and Information Science of Wuhan University ,2014 ,39 (5 ) :505 – 513 .

[本文引用: 1]

李德仁 ,李明 无人机遥感系统的研究进展与应用前景

[J].武汉大学学报·信息科学版 ,2014 ,39 (5 ):505 -513 .

[本文引用: 1]

[9]

Wang Xiaoqin Wang Miaomiao Wang Shaoqiang et al Extraction of Vegetation Information from Visible Unmanned Aerial Vehicle Images

[J].Transactions of the Chinese Society of Agricultural Engineering ,2015 ,31 (5 ):152 -159 .

[本文引用: 1]

汪小钦 ,王苗苗 ,王绍强 ,等 基于可见光波段无人机遥感的植被信息提取

[J].农业工程学报 ,2015 ,31 (5 ):152 -159 .

[本文引用: 1]

[10]

Fu Wenjie Lin Mingsen Study on Extracting of Eoquat Information Using SVM and Gray-level Co-occurrence Matrix from QuickBird Image

[J].Remote Sensing Technology and Application ,2010 ,25 (5 ): 695 -699 .

傅文杰 ,林明森 利用SVM与灰度共生矩阵从QuickBird影像中提取枇杷信息

[J].遥感技术与应用 ,2010 ,25 (5 ):695 -699 .

[11]

Feng Jingjing Zhang Xiaoli Liu Huiling Single Tree Crown Extraction based on Gray Gradient Image Segmentation

[J].Journal of Beijing Forestry University ,2017 ,39 (3 ):16 -23 .

冯静静 ,张晓丽 ,刘会玲 基于灰度梯度图像分割的单木树冠提取研究

[J].北京林业大学学报 ,2017 ,39 (3 ):16 -23 .

[12]

Culvenor D S An Algorithm for The Delineation of Tree Crowns in High Spatial Resolution Remotely Sensed Imagery

[J].Computers and Geosciences ,2002 ,28 (1 ):33 -44 .

[本文引用: 1]

[13]

Katoh M Gougeon F A Leckie D G Application of High-resolution Airborne Data Using Individual Tree Crowns in Japanese Conifer Plantations

[J].Journal of Forest Research ,2009 ,14 (1 ):10 -19 .

[本文引用: 1]

[14]

Gomes M F Maillard P Detection of Tree Crowns in Very High Spatial Resolution Images

[J]. Environmental Applications of Remote Sensing ,2016 (8 ):41 -71 .

[15]

Pouliot D King D Approaches for Optimal Automated Individual Tree Crown Detection in Regenerating Coniferous Forests

[J].Canadian Journal of Remote Sensing ,2005 ,31 (3 ):255 -267 .

[本文引用: 1]

[16]

Zhang Ning Feng Yuewen Zhang Xiaoli et al Extracting Individual Tree Crown by Combining Spectral and Texture Features from Aerial Images

[J].Journal of Beijing Forestry University ,2015 ,37 (3 ):13 -19 .

[本文引用: 1]

张凝 ,冯跃文 ,张晓丽 ,等 结合航空影像纹理和光谱特征的单木冠幅提取

[J].北京林业大学学报 ,2015 ,37 (3 ):13 -19 .

[本文引用: 1]

[17]

Shen Liqiang Jiang Renrong Wang Peifa A Method for Individual Tree-crown Extraction from High Spatial Resolution Imagery

[J].Remote Sensing Information ,2017 ,32 (3 ):142 -148 .

[本文引用: 1]

沈利强 ,姜仁荣 ,王培法 一种高分辨率遥感图像单木树冠信息提取方法

[J].遥感信息 ,2017 ,32 (3 ):142 -148 .

[本文引用: 1]

[18]

Bu Fan Shi Yuli The Comparison of Urban Tree Crown Extraction based on Airborne LiDAR Elevation Difference and High Resolution Imagery

[J].Remote Sensing Technology and Application .2017 ,32 (5 ):875 -882 .

[本文引用: 1]

卜帆 石玉立,机载LiDAR 高差和高分影像的城市树冠提取比较

[J].遥感技术与应用 ,2017 ,32 (5 ) :875 -882 .

[本文引用: 1]

[19]

Liu Qingwang Li Shiming Li Zengyuan et al Review on the Applications of UAV-based LiDAR and Photogrammetry in Forestry

[J].Scientia Silvae Sinicae ,2017 ,53 (7 ):134 -148 .

[本文引用: 1]

刘清旺 ,李世明 ,李增元 ,符利勇 ,胡凯龙 无人机激光雷达与摄影测量林业应用研究进展

[J].林业科学 ,2017 ,53 (7 ):134 -148 .

[本文引用: 1]

[20]

Zhou Honghua Li Weihong Sun Huilan Reconstruction of Groundwater Depth Using Tree-rings of Populus Euphratica in The Lower Tarim River

[J].Scientia Silvae Sinicae ,2018 ,54 (4 ):11 -16 .

[本文引用: 1]

周洪华 ,李卫红 ,孙慧兰 基于胡杨年轮的塔里木河下游地下水埋深历史重建

[J].林业科学 ,2018 ,54 (4 ):11 -16 .

[本文引用: 1]

[21]

Long J Shelhamer E Darrell T Fully Convolutional Networks for Semantic Segmentation

[J].Computer Vision and Pattern Recognition ,2015 ,79 (11 ):3431 -3440 .

[本文引用: 1]

[22]

Dong Yunya Zhang Qian A Survey of Depth Semantic Feature Extraction of High-resolution Remote Sensing Images based on CNN

[J]. Remote Sensing Technology and Application ,2019 ,34 (1 ):1 -11 .

[本文引用: 1]

董蕴雅 ,张倩 基于CNN的高分遥感影像深度语义特征提取研究综述

[J].遥感技术与应用 ,2019 ,34 (1 ):1 -11 .

[本文引用: 1]

[23]

Wu Guangming Chen Qi Shibasaki Ryosuke et al High Precision Building Detection from Aerial Imagery Using a U-Net Like Convolutional Architecture

[J]. Acta Geodaetica et Cartographica Sinica , 2018 ,47 (6 ):864 -872 .

[本文引用: 1]

伍广明 ,陈奇 , Shibasaki Ryosuke 等 基于U型卷积神经网络的航空影像建筑物检测

[J]. 测绘学报 ,2018 ,47 (6 ):864 -872 .

[本文引用: 1]

[24]

Vincent L Soille P Watersheds in Digital Spaces:An Efficient Algorithm based on Immersion Simulations

[J].IEEE Transactions on Pattern Analysis and Machine Intelligence ,1991 ,13 (6 ):583 -598 .

[本文引用: 1]

[25]

Gonzales R C Woods R E et al Digital Image Processing

[M].Beijing :Digital Image Processing .2011 .冈萨雷斯 ,伍兹,等 .数字图像处理[M].北京 :电子工业出版社 ,2011.

[本文引用: 1]

[26]

Guo Yushan Liu Qingsheng Liu Gaohuan et al Individual Tree Crown Extraction of High Resolution Image based on Marker-controlled Watershed Segmentation Method

[J]. Journal of Geo-information Science ,2016 ,18 (9 ):1259 -1266 .

[本文引用: 2]

郭昱杉 ,刘庆生 ,刘高焕 ,等 基于标记控制分水岭分割方法的高分辨率遥感影像单木树冠提取

[J].地球信息科学学报 ,2016 ,18 (9 ):1259 -1266 .

[本文引用: 2]

[27]

HeYi , Zhou Xiaocheng HuangHongyu ,et al Counting Tree Numberin Subtropical Forest Districts based on UAV Remote Sensing Images

[J].Remote Sensing Technology and Application ,2018 ,33 (1 ):168 -176 .

[本文引用: 1]

何艺 ,周小成 ,黄洪宇 ,等 基于无人机遥感的亚热带森林林分株数提取

[J].遥感技术与应用 ,2018 ,33 (1 ):168 -176 .

[本文引用: 1]

干旱区内陆河流域的生态安全与生态需水量研究

1

2008

... 塔里木河流域胡杨林(populus euphratica forest)是该荒漠生态系统的重要组成部分,维系着荒漠区域能量与物质的循环[1 ] .胡杨树冠的覆盖度、株数等信息是指导森林经营管理的重要指标,因此提取胡杨树冠的覆盖范围和株数等信息对塔里木河流域森林资源监测保护具有重要意义[2 -3 ] . ...

干旱区内陆河流域的生态安全与生态需水量研究

1

2008

... 塔里木河流域胡杨林(populus euphratica forest)是该荒漠生态系统的重要组成部分,维系着荒漠区域能量与物质的循环[1 ] .胡杨树冠的覆盖度、株数等信息是指导森林经营管理的重要指标,因此提取胡杨树冠的覆盖范围和株数等信息对塔里木河流域森林资源监测保护具有重要意义[2 -3 ] . ...

Mapping Tree Density at a Global Scale

2

2015

... 塔里木河流域胡杨林(populus euphratica forest)是该荒漠生态系统的重要组成部分,维系着荒漠区域能量与物质的循环[1 ] .胡杨树冠的覆盖度、株数等信息是指导森林经营管理的重要指标,因此提取胡杨树冠的覆盖范围和株数等信息对塔里木河流域森林资源监测保护具有重要意义[2 -3 ] . ...

... 从表2 数据观察可知,结构元尺寸的大小跟提取出来的株数成反比.因为,结构元尺寸越大,对图像平滑尺度越大,更多的特征点被周围相元“同化”,得到的结果就会偏小,造成漏分割现象;相反,结构元尺寸越小,保留的特征点越多,使用分水岭算法就会得到更多的株数,造成过分割现象.所以,为了寻找最合适的分割尺度,将结果分别做线性回归拟合(图8 ),实验证明结构元尺寸为6的时候R 2 取得最大值0.89,表明此时可以取得最佳分割效果,图8 中绿色的线是使用结构元尺寸为6的测试结果.Crowther等[2 ] 在计算全球树木株数时候R 2 高达0.97,因为本研究验证样方数量少,并且选择的样方区域大小相同,最终株数大多聚集在60~80之间,影响了拟合结果;选择不同面积的样方计算出的株数值会产生离散效果,进行拟合会更加接近1∶1标准线,可以提高拟合精度. ...

高空间分辨率卫星遥感影像树冠信息提取方法研究

1

2005

... 塔里木河流域胡杨林(populus euphratica forest)是该荒漠生态系统的重要组成部分,维系着荒漠区域能量与物质的循环[1 ] .胡杨树冠的覆盖度、株数等信息是指导森林经营管理的重要指标,因此提取胡杨树冠的覆盖范围和株数等信息对塔里木河流域森林资源监测保护具有重要意义[2 -3 ] . ...

高空间分辨率卫星遥感影像树冠信息提取方法研究

1

2005

... 塔里木河流域胡杨林(populus euphratica forest)是该荒漠生态系统的重要组成部分,维系着荒漠区域能量与物质的循环[1 ] .胡杨树冠的覆盖度、株数等信息是指导森林经营管理的重要指标,因此提取胡杨树冠的覆盖范围和株数等信息对塔里木河流域森林资源监测保护具有重要意义[2 -3 ] . ...

ImageNet Classification with Deep Convolutional Neural Networks

1

2012

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

Deep Learning based Oil Palm Tree Detection and Counting for High-resolution Remote Sensing Images

1

2016

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

U-Net:Convolutional Networks for Biomedical Image Segmentation

2

2015

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

... U-Net网络设计是通过采用多次对图像的收缩(左边)和扩张(右边)构成对称结构[6 ] ,进行特征学习和建立特征训练库,其中收缩和扩张次数取决于实现图像金字塔多分辨率结构中下采样和上采样的级数(图3 ).该网络遵循典型的卷积网络结构,每进行一次收缩,需要经历两次卷积和一次下采样操作,由于训练采用500×500像素的小样本图片,收缩次数过多会导致图片尺寸过小、维度过高,不适合训练特征,收缩次数太少则无法学习到更高维特征,综合考虑测试设置4层收缩网络较为合适.每次卷积步骤均使用3×3卷积核(stride =1,padding =1)和修正线性单元(rectified linear unit,ReLU)激活函数组成,然后进行2×2最大池化(stride =2,padding =0)步骤完成一次下采样.同样在扩张路径中每次卷积操作之前,通过矩阵级联的方式与收缩路径中对应层的高分辨率特征进行融合,卷积层可以基于融合的信息学习更加精准的特征输出,从而更好地修复目标细节,提高分割精度. ...

无人机遥感在生态学中的应用进展

1

2018

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

无人机遥感在生态学中的应用进展

1

2018

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

无人机遥感系统的研究进展与应用前景

1

2014

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

无人机遥感系统的研究进展与应用前景

1

2014

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

基于可见光波段无人机遥感的植被信息提取

1

2015

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

基于可见光波段无人机遥感的植被信息提取

1

2015

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

利用SVM与灰度共生矩阵从QuickBird影像中提取枇杷信息

0

2010

利用SVM与灰度共生矩阵从QuickBird影像中提取枇杷信息

0

2010

基于灰度梯度图像分割的单木树冠提取研究

0

2017

基于灰度梯度图像分割的单木树冠提取研究

0

2017

An Algorithm for The Delineation of Tree Crowns in High Spatial Resolution Remotely Sensed Imagery

1

2002

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

Application of High-resolution Airborne Data Using Individual Tree Crowns in Japanese Conifer Plantations

1

2009

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

Detection of Tree Crowns in Very High Spatial Resolution Images

0

2016

Approaches for Optimal Automated Individual Tree Crown Detection in Regenerating Coniferous Forests

1

2005

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

结合航空影像纹理和光谱特征的单木冠幅提取

1

2015

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

结合航空影像纹理和光谱特征的单木冠幅提取

1

2015

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

一种高分辨率遥感图像单木树冠信息提取方法

1

2017

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

一种高分辨率遥感图像单木树冠信息提取方法

1

2017

... 随着近几年计算机软硬件水平的提升,以卷积神经网络[4 ] (Convolutional Neural Network,CNN)为代表的深度学习技术得到了极大发展,越来越多的学者开始关注深度学习在森林资源监测方面的应用[5 ] ,为进一步提高遥感影像分割精度提供了更多的可行方案.然而,由于传统的CNN在向前卷积传播过程中图像分辨率不断下降,使得末端的训练样本结果分辨率偏低,当前的深度学习算法对卷积过程进行了新的设计来提高样品训练结果的保真性,如U-Net卷积神经网络[6 ] .另一方面,无人机遥感监测技术具有高时空分辨率、高机动性、低成本等优势[7 ] ,可以快速进行处理、建模和分析,能够有效克服传统实地调查方法存在的费时费力、大规模测量困难等缺陷,为大面积树冠信息的详情掌握提供了有效手段[8 ] .当前,基于高分辨率影像数据的树冠信息提取方法可总结为以下3类:①利用影像光谱和纹理信息的直接提取方法[9 -12 ] ;②基于几何光学特征和影像特征的算法探测树冠边界[13 -15 ] ;③采用面向对象的多尺度分割方法提取树冠信息[16 -17 ] .在这些研究中,大多数学者多采用一至两种方法提取树冠.然而,采用适当的深度学习方法进行树冠范围精准提取,并进一步实现单木树冠分割的集成方法研究鲜见报道. ...

石玉立,机载LiDAR 高差和高分影像的城市树冠提取比较

1

2017

... 塔里木河流域胡杨空间分布极其不均,生长状态变化多样,其树冠光谱反射率无恒定阈值,且与周围柽柳、梭梭等绿色植被并存生长,这些客观因素都会对胡杨树冠提取的精度造成很大的影响[18 ] ,所以传统方法很难直接应用于该流域树冠提取和株数计算[19 ] .针对以上问题,首次提出了集成U-Net卷积神经网络和标记分水岭方法,先进行胡杨树冠覆盖区域的识别分割,再将分割后的密集区进行单株胡杨分割计数.其计算流程主要包括以下两步:①通过U-Net卷积神经网络对无人机影像数据处理实现初次分割,获取胡杨树冠的精准边界范围;②在提取树冠边界的基础上,采用改进的标记分水岭方法对密集区域树冠进行二次分割,实现单木树冠分割并计数. ...

石玉立,机载LiDAR 高差和高分影像的城市树冠提取比较

1

2017

... 塔里木河流域胡杨空间分布极其不均,生长状态变化多样,其树冠光谱反射率无恒定阈值,且与周围柽柳、梭梭等绿色植被并存生长,这些客观因素都会对胡杨树冠提取的精度造成很大的影响[18 ] ,所以传统方法很难直接应用于该流域树冠提取和株数计算[19 ] .针对以上问题,首次提出了集成U-Net卷积神经网络和标记分水岭方法,先进行胡杨树冠覆盖区域的识别分割,再将分割后的密集区进行单株胡杨分割计数.其计算流程主要包括以下两步:①通过U-Net卷积神经网络对无人机影像数据处理实现初次分割,获取胡杨树冠的精准边界范围;②在提取树冠边界的基础上,采用改进的标记分水岭方法对密集区域树冠进行二次分割,实现单木树冠分割并计数. ...

无人机激光雷达与摄影测量林业应用研究进展

1

2017

... 塔里木河流域胡杨空间分布极其不均,生长状态变化多样,其树冠光谱反射率无恒定阈值,且与周围柽柳、梭梭等绿色植被并存生长,这些客观因素都会对胡杨树冠提取的精度造成很大的影响[18 ] ,所以传统方法很难直接应用于该流域树冠提取和株数计算[19 ] .针对以上问题,首次提出了集成U-Net卷积神经网络和标记分水岭方法,先进行胡杨树冠覆盖区域的识别分割,再将分割后的密集区进行单株胡杨分割计数.其计算流程主要包括以下两步:①通过U-Net卷积神经网络对无人机影像数据处理实现初次分割,获取胡杨树冠的精准边界范围;②在提取树冠边界的基础上,采用改进的标记分水岭方法对密集区域树冠进行二次分割,实现单木树冠分割并计数. ...

无人机激光雷达与摄影测量林业应用研究进展

1

2017

... 塔里木河流域胡杨空间分布极其不均,生长状态变化多样,其树冠光谱反射率无恒定阈值,且与周围柽柳、梭梭等绿色植被并存生长,这些客观因素都会对胡杨树冠提取的精度造成很大的影响[18 ] ,所以传统方法很难直接应用于该流域树冠提取和株数计算[19 ] .针对以上问题,首次提出了集成U-Net卷积神经网络和标记分水岭方法,先进行胡杨树冠覆盖区域的识别分割,再将分割后的密集区进行单株胡杨分割计数.其计算流程主要包括以下两步:①通过U-Net卷积神经网络对无人机影像数据处理实现初次分割,获取胡杨树冠的精准边界范围;②在提取树冠边界的基础上,采用改进的标记分水岭方法对密集区域树冠进行二次分割,实现单木树冠分割并计数. ...

基于胡杨年轮的塔里木河下游地下水埋深历史重建

1

2018

... 研究区为塔里木河中游部分(图1 ),该区属典型的大陆性暖温带荒漠干旱气候,该区蒸发强烈,高温少雨.主要以杨柳科、柽柳科和夹竹桃科等植物为主,构成了乔木、灌木和草本等伴生植物群落.塔里木河两岸的胡杨林是干旱荒漠地区唯一森林资源,对绿化荒漠起着非常重要的作用,也是维系塔里木河流域生态系统稳定的唯一树种,胡杨树冠及株数的精准识别与检测对保护塔里木河流域胡杨及其生态系统具有重要意义[20 ] . ...

基于胡杨年轮的塔里木河下游地下水埋深历史重建

1

2018

... 研究区为塔里木河中游部分(图1 ),该区属典型的大陆性暖温带荒漠干旱气候,该区蒸发强烈,高温少雨.主要以杨柳科、柽柳科和夹竹桃科等植物为主,构成了乔木、灌木和草本等伴生植物群落.塔里木河两岸的胡杨林是干旱荒漠地区唯一森林资源,对绿化荒漠起着非常重要的作用,也是维系塔里木河流域生态系统稳定的唯一树种,胡杨树冠及株数的精准识别与检测对保护塔里木河流域胡杨及其生态系统具有重要意义[20 ] . ...

Fully Convolutional Networks for Semantic Segmentation

1

2015

... 传统的深度学习方法如卷积神经网络模型(Convolutional Neural Networks,CNN)的池化层通过多次卷积逐步降低了图像分辨率,丢失了特征空间信息,无法将遥感影像目标的边界精准勾画出来.鉴于此,来自伯克利的Long等[21 ] 使用全卷积网络(Fully Convolutional Network,FCN)模型改进了经典的CNN模型,对CNN最后一个卷积层的特征图进行反卷积处理,将特征图尺寸恢复至与原始图像分辨率一致的输出层[22 ] ,保留了空间位置信息,并且可以实现了图像的像素级分类.FCN生成最后的特征图之前经历了多次池化处理,导致许多图像细节丢失,得到的分割结果往往过于平滑,原始图像很多细节无法还原,从而无法精确地提取目标轮廓[23 ] .针对FCN的不足,U-Net模型对FCN端对端的思想进行了扩展和延伸,采用编码器-解码器结构建立快捷连接,帮助解码器更好地修复目标的细节,并且尽可能地保真和还原原始图像的空间信息,从而最大限度地保留了深度学习方法中训练集的原始特征如分割对象的边缘特征、纹理特征和形状特征等. ...

基于CNN的高分遥感影像深度语义特征提取研究综述

1

2019

... 传统的深度学习方法如卷积神经网络模型(Convolutional Neural Networks,CNN)的池化层通过多次卷积逐步降低了图像分辨率,丢失了特征空间信息,无法将遥感影像目标的边界精准勾画出来.鉴于此,来自伯克利的Long等[21 ] 使用全卷积网络(Fully Convolutional Network,FCN)模型改进了经典的CNN模型,对CNN最后一个卷积层的特征图进行反卷积处理,将特征图尺寸恢复至与原始图像分辨率一致的输出层[22 ] ,保留了空间位置信息,并且可以实现了图像的像素级分类.FCN生成最后的特征图之前经历了多次池化处理,导致许多图像细节丢失,得到的分割结果往往过于平滑,原始图像很多细节无法还原,从而无法精确地提取目标轮廓[23 ] .针对FCN的不足,U-Net模型对FCN端对端的思想进行了扩展和延伸,采用编码器-解码器结构建立快捷连接,帮助解码器更好地修复目标的细节,并且尽可能地保真和还原原始图像的空间信息,从而最大限度地保留了深度学习方法中训练集的原始特征如分割对象的边缘特征、纹理特征和形状特征等. ...

基于CNN的高分遥感影像深度语义特征提取研究综述

1

2019

... 传统的深度学习方法如卷积神经网络模型(Convolutional Neural Networks,CNN)的池化层通过多次卷积逐步降低了图像分辨率,丢失了特征空间信息,无法将遥感影像目标的边界精准勾画出来.鉴于此,来自伯克利的Long等[21 ] 使用全卷积网络(Fully Convolutional Network,FCN)模型改进了经典的CNN模型,对CNN最后一个卷积层的特征图进行反卷积处理,将特征图尺寸恢复至与原始图像分辨率一致的输出层[22 ] ,保留了空间位置信息,并且可以实现了图像的像素级分类.FCN生成最后的特征图之前经历了多次池化处理,导致许多图像细节丢失,得到的分割结果往往过于平滑,原始图像很多细节无法还原,从而无法精确地提取目标轮廓[23 ] .针对FCN的不足,U-Net模型对FCN端对端的思想进行了扩展和延伸,采用编码器-解码器结构建立快捷连接,帮助解码器更好地修复目标的细节,并且尽可能地保真和还原原始图像的空间信息,从而最大限度地保留了深度学习方法中训练集的原始特征如分割对象的边缘特征、纹理特征和形状特征等. ...

基于U型卷积神经网络的航空影像建筑物检测

1

2018

... 传统的深度学习方法如卷积神经网络模型(Convolutional Neural Networks,CNN)的池化层通过多次卷积逐步降低了图像分辨率,丢失了特征空间信息,无法将遥感影像目标的边界精准勾画出来.鉴于此,来自伯克利的Long等[21 ] 使用全卷积网络(Fully Convolutional Network,FCN)模型改进了经典的CNN模型,对CNN最后一个卷积层的特征图进行反卷积处理,将特征图尺寸恢复至与原始图像分辨率一致的输出层[22 ] ,保留了空间位置信息,并且可以实现了图像的像素级分类.FCN生成最后的特征图之前经历了多次池化处理,导致许多图像细节丢失,得到的分割结果往往过于平滑,原始图像很多细节无法还原,从而无法精确地提取目标轮廓[23 ] .针对FCN的不足,U-Net模型对FCN端对端的思想进行了扩展和延伸,采用编码器-解码器结构建立快捷连接,帮助解码器更好地修复目标的细节,并且尽可能地保真和还原原始图像的空间信息,从而最大限度地保留了深度学习方法中训练集的原始特征如分割对象的边缘特征、纹理特征和形状特征等. ...

基于U型卷积神经网络的航空影像建筑物检测

1

2018

... 传统的深度学习方法如卷积神经网络模型(Convolutional Neural Networks,CNN)的池化层通过多次卷积逐步降低了图像分辨率,丢失了特征空间信息,无法将遥感影像目标的边界精准勾画出来.鉴于此,来自伯克利的Long等[21 ] 使用全卷积网络(Fully Convolutional Network,FCN)模型改进了经典的CNN模型,对CNN最后一个卷积层的特征图进行反卷积处理,将特征图尺寸恢复至与原始图像分辨率一致的输出层[22 ] ,保留了空间位置信息,并且可以实现了图像的像素级分类.FCN生成最后的特征图之前经历了多次池化处理,导致许多图像细节丢失,得到的分割结果往往过于平滑,原始图像很多细节无法还原,从而无法精确地提取目标轮廓[23 ] .针对FCN的不足,U-Net模型对FCN端对端的思想进行了扩展和延伸,采用编码器-解码器结构建立快捷连接,帮助解码器更好地修复目标的细节,并且尽可能地保真和还原原始图像的空间信息,从而最大限度地保留了深度学习方法中训练集的原始特征如分割对象的边缘特征、纹理特征和形状特征等. ...

Watersheds in Digital Spaces:An Efficient Algorithm based on Immersion Simulations

1

1991

... 由于胡杨属于阔叶林,不同于针叶林只存在一个极值点,胡杨树冠会存在很多局部最大值,直接使用标准的分水岭方法很容易将这些局部极值检测出来造成过分割现象.为了消除过多的局部极值和噪声的影响,在运用传统分水岭算法[24 ] 之前,需要对分割后的密集区胡杨树冠图像做形态学开运算处理,形态学的开运算实质上是先腐蚀后膨胀的过程.利用灰度级形态学开运算进行滤波重建,在保证平滑图像的同时又消除了过多的噪声,同时最大限度地保留和提高了被分割对象的有效图像特征,减少了分割不足和过分割的情况. ...

Digital Image Processing

1

2011

... 给定一副图像中感兴趣特性所使用的小集合或者子图像记为结构元b ,当b 的原点位于(x,y )处时,腐蚀运算的定义为图像ƒ 中与b 重合区域的最小值[25 ] .结构元b 对一副图像ƒ 在位置(x,y )处的腐蚀定义公式如下: ...

基于标记控制分水岭分割方法的高分辨率遥感影像单木树冠提取

2

2016

... 分水岭分割算法是根据形态学思想,将图像模拟成一幅高低起伏的地形,像元值的大小代表地形图海拔的高低,局部极小值区域称为集水盆,假设水慢慢浸入并且开始淹没表面时,在不同的汇水盆区域建造大坝防止其汇合,这个修建起来的大坝就形成了分水岭[26 ] .观察密集区胡杨树冠,相互重叠在一起的胡杨树冠会形成明暗不同的类似分水岭的交界线,因此可运用分水岭方法进行密集区树冠分割. ...

... 基于上一步分割得到的密集胡杨区域,利用平滑处理后的图像特征,使用标记分水岭方法可以将密集的胡杨林分割成单株的胡杨,从而自动计数.本实验使用结构元尺寸为6的开运算处理后对上述10个样方进行标记分水岭方法分类,精度验证结果如表3 所示.总体精度高达到98.63%,总体误授误差为14.81%,总体漏分误差为13.44%.平均总体精度为93.29%,较总体精度相差5.34%,分析可知是因为提取株数在实测株数值左右浮动,将10个提取株数样本求总数正好和实测株数值相差很小,所以根据总体计算公式求得总体精度较高,使用平均总体精度93.29%可以更加准确的表达分类精度.何艺等[27 ] 使用多尺度分割算法对阔叶林样地株数提取总体精度达到90.34%,本研究总体精度为93.29%,精度提高了2.95%.郭昱杉等[26 ] 单独使用标记分水岭方法进行阔叶林单木树冠提取,准确率为65.55%,本研究通过深度学习进行初步分割,再使用标记分水岭分割,平均准确率达到84.75%,提高了19.2%,说明融合集成应用U-Net深度学习和分水岭分割的方法比单独使用标记分水岭分割有更好的精度. ...

基于标记控制分水岭分割方法的高分辨率遥感影像单木树冠提取

2

2016

... 分水岭分割算法是根据形态学思想,将图像模拟成一幅高低起伏的地形,像元值的大小代表地形图海拔的高低,局部极小值区域称为集水盆,假设水慢慢浸入并且开始淹没表面时,在不同的汇水盆区域建造大坝防止其汇合,这个修建起来的大坝就形成了分水岭[26 ] .观察密集区胡杨树冠,相互重叠在一起的胡杨树冠会形成明暗不同的类似分水岭的交界线,因此可运用分水岭方法进行密集区树冠分割. ...

... 基于上一步分割得到的密集胡杨区域,利用平滑处理后的图像特征,使用标记分水岭方法可以将密集的胡杨林分割成单株的胡杨,从而自动计数.本实验使用结构元尺寸为6的开运算处理后对上述10个样方进行标记分水岭方法分类,精度验证结果如表3 所示.总体精度高达到98.63%,总体误授误差为14.81%,总体漏分误差为13.44%.平均总体精度为93.29%,较总体精度相差5.34%,分析可知是因为提取株数在实测株数值左右浮动,将10个提取株数样本求总数正好和实测株数值相差很小,所以根据总体计算公式求得总体精度较高,使用平均总体精度93.29%可以更加准确的表达分类精度.何艺等[27 ] 使用多尺度分割算法对阔叶林样地株数提取总体精度达到90.34%,本研究总体精度为93.29%,精度提高了2.95%.郭昱杉等[26 ] 单独使用标记分水岭方法进行阔叶林单木树冠提取,准确率为65.55%,本研究通过深度学习进行初步分割,再使用标记分水岭分割,平均准确率达到84.75%,提高了19.2%,说明融合集成应用U-Net深度学习和分水岭分割的方法比单独使用标记分水岭分割有更好的精度. ...

基于无人机遥感的亚热带森林林分株数提取

1

2018

... 基于上一步分割得到的密集胡杨区域,利用平滑处理后的图像特征,使用标记分水岭方法可以将密集的胡杨林分割成单株的胡杨,从而自动计数.本实验使用结构元尺寸为6的开运算处理后对上述10个样方进行标记分水岭方法分类,精度验证结果如表3 所示.总体精度高达到98.63%,总体误授误差为14.81%,总体漏分误差为13.44%.平均总体精度为93.29%,较总体精度相差5.34%,分析可知是因为提取株数在实测株数值左右浮动,将10个提取株数样本求总数正好和实测株数值相差很小,所以根据总体计算公式求得总体精度较高,使用平均总体精度93.29%可以更加准确的表达分类精度.何艺等[27 ] 使用多尺度分割算法对阔叶林样地株数提取总体精度达到90.34%,本研究总体精度为93.29%,精度提高了2.95%.郭昱杉等[26 ] 单独使用标记分水岭方法进行阔叶林单木树冠提取,准确率为65.55%,本研究通过深度学习进行初步分割,再使用标记分水岭分割,平均准确率达到84.75%,提高了19.2%,说明融合集成应用U-Net深度学习和分水岭分割的方法比单独使用标记分水岭分割有更好的精度. ...

基于无人机遥感的亚热带森林林分株数提取

1

2018

... 基于上一步分割得到的密集胡杨区域,利用平滑处理后的图像特征,使用标记分水岭方法可以将密集的胡杨林分割成单株的胡杨,从而自动计数.本实验使用结构元尺寸为6的开运算处理后对上述10个样方进行标记分水岭方法分类,精度验证结果如表3 所示.总体精度高达到98.63%,总体误授误差为14.81%,总体漏分误差为13.44%.平均总体精度为93.29%,较总体精度相差5.34%,分析可知是因为提取株数在实测株数值左右浮动,将10个提取株数样本求总数正好和实测株数值相差很小,所以根据总体计算公式求得总体精度较高,使用平均总体精度93.29%可以更加准确的表达分类精度.何艺等[27 ] 使用多尺度分割算法对阔叶林样地株数提取总体精度达到90.34%,本研究总体精度为93.29%,精度提高了2.95%.郭昱杉等[26 ] 单独使用标记分水岭方法进行阔叶林单木树冠提取,准确率为65.55%,本研究通过深度学习进行初步分割,再使用标记分水岭分割,平均准确率达到84.75%,提高了19.2%,说明融合集成应用U-Net深度学习和分水岭分割的方法比单独使用标记分水岭分割有更好的精度. ...