1 引 言

对于道路提取,相关学者已经做了大量的研究工作。张永宏等[4]对现有的道路提取模型做了全面的分析与总结,将其按照道路提取的层次进展分为以下3类:基于像元、对象和深度学习等方法。基于像元的道路提取方法能够充分利用影像的光谱特征和空间特征,如Richard等[5]利用光谱特征进行提取,罗庆洲等[6]利用光谱特征和几何特征进行提取。该类方法能够在场景简单的影像中可以较好地提取道路,但在复杂场景下,则较难区分道路和建筑物及其阴影。基于对象的方法利用空间、纹理和光谱特征,将临近像元作为对象来识别影像,如蔡红玥等[7]提出的改进的分水岭算法,余长慧等[8]提出的利用MRF的方法,Li等[9]提出的利用模糊集理论进行区域合并的方法,曹云刚等[10]提出的像元与对象特征融合的高分辨率遥感影像道路中心线提取方法,Das等[11]提出的利用多光谱影像的局部线性特征结合支持向量机对道路进行提取的方法。该类算法可以较好地提取道路,但对于空间位置相邻、几何形状相似的地物较难区分。基于深度学习的方法使计算机可从浅层的特征自动学习更加复杂抽象的特征,从而能够准确和高效地进行分类判别,如刘笑等[12]提出的基于全卷积神经网络的方法,贺浩等[13]提出的基于Encoder-Decoder网络的方法,Kampffmeyer等[14-17]提出的应用FCN及其改进的道路提取方法,Kestur[18]等提出的UFCN网络模型,Zhang等[19]提出的基于ResNet与U-Net的网络模型,Panboonyuen等[20]提出的基于SegNet与ELU的网络模型。该类方法可以较好地将道路区域进行分割,但其分割结果存在孤立点与断裂道路。综上所述,以上3种算法都不能很好地提取道路信息,提取的准确率有待进一步提升。

U-Net[21]在保留了高级的语义信息的同时采用跳跃连接顾及了低级的细节信息[19],对生物医学影像分割效果较好,但训练易出现过拟合,分割效果不能满足道路提取的需求。王宇等[22]提出结合残差网络的建筑物提取方法,以Encoder-Decoder为基础,引入残差网络结构和Batch Normalization,提高了分类精度。崔刚等[23]为研究不同分辨率图像的冬小麦识别效果,采用了基于PSPNet[24]的网络结构,该结构采用了跳跃连接,冬小麦识别研究中取得了很好的效果。为此,提出了一种改进U-Net的高分辨率遥感影像道路提取方法,利用Batch Normalization、ELU与Dropout较好地解决了过拟合所导致的准确率较低的问题,并利用TGRS2017数据集[25]进行了有关实验,实现道路信息的高维、复杂、抽象特征的自动提取,解决目前算法提取结果存在较多孤立点与少量断裂道路的问题。

2 遥感影像道路提取方法

基于U-Net网络模型提取道路信息的实验过程具体如下:首先,将高分辨率遥感数据进行人工解译,并对其训练数据根据网络结构和硬件需求裁剪成相应大小,制作训练数据集。实验采用的数据集为TGRS2017数据集[14],并对该数据集进行旋转与镜像的操作进行扩充。其次,将训练数据输入实验网络模型进行学习与训练,不断更新网络模型中的参数,使损失值减少到最低,保存当前网络模型。最后,利用其训练好的网络模型进行道路提取。

2.1 U-Net与VGG16

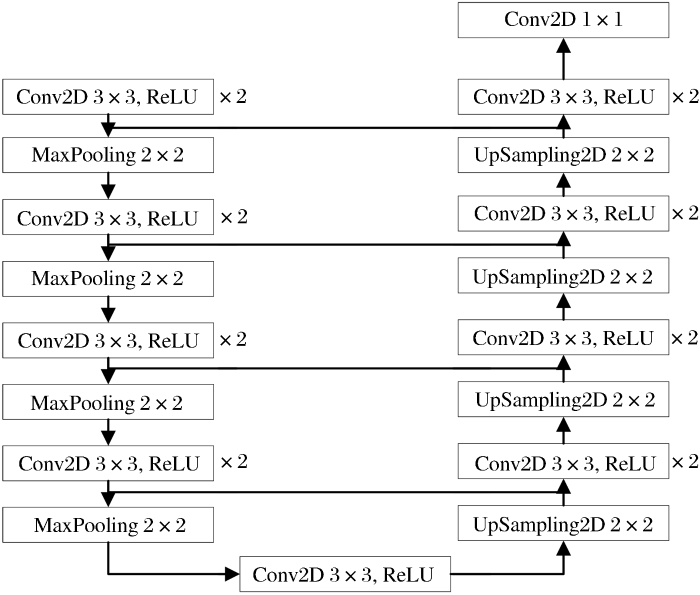

U-Net[21]于2015年由Ronneberger等提出,其网络结构如图1所示,图中Conv2D代表卷积计算,MaxPooling为最大池化操作,UpSampling2D 为上采样计算。U-Net网络是由用于获取上下文信息的编码路径与用于实现精确定位的对称扩展路径组成。其中收缩编码路径与卷积神经网络的典型结构相同,由卷积计算与池化计算交替组合而成,逐渐缩小特征图像大小,同时增加每一层的特征图像数量。扩展路径每一组计算都包含该特征图像的上采样操作,然后进行卷积计算。因扩展路径会扩大输出特征图像的分辨率,为精确化上采样特征图像,在扩展路径中采用跳跃连接将其收缩路径中的高分辨率特征图像相结合。模型的输出为图像蒙版,用于表示不同的要素。

图1

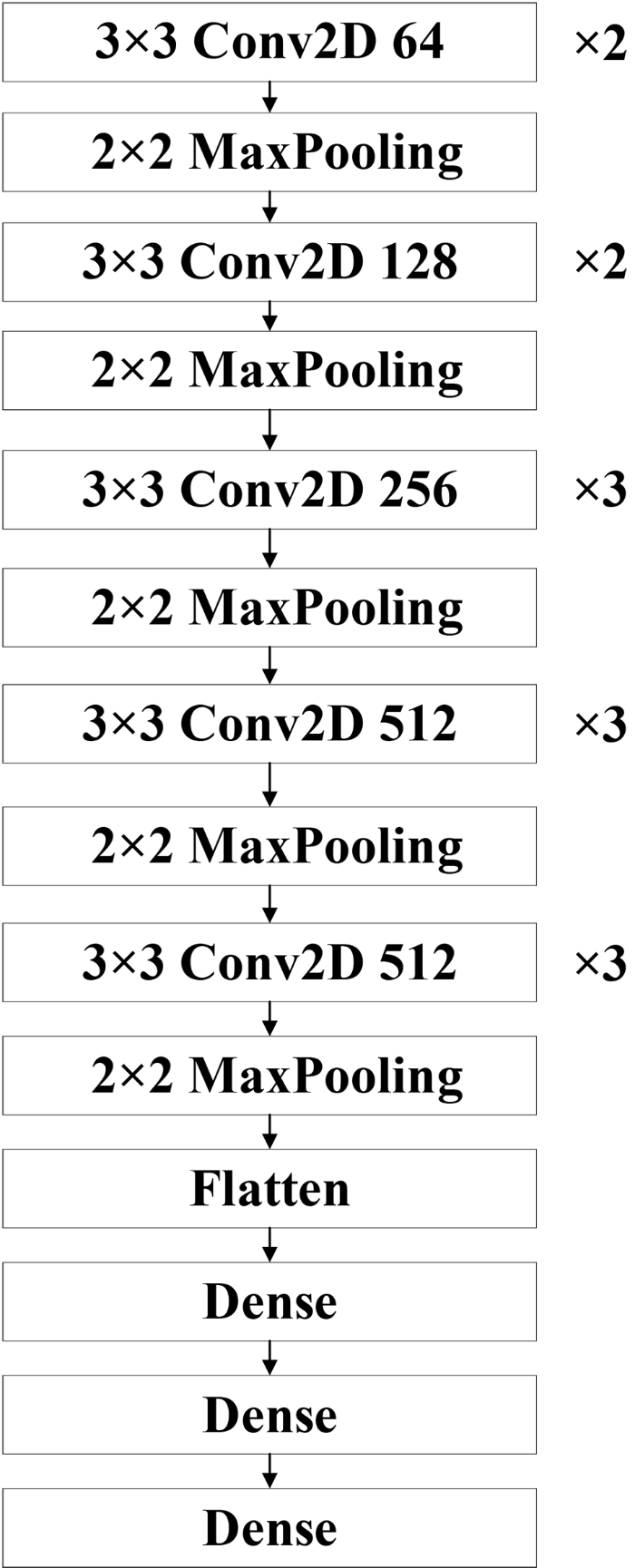

VGGNet[26]于2014年被牛津大学计算机视觉组和Google DeepMind提出,并在2014年ILSVRC比赛中取得定位任务冠军和分类任务亚军。VGGNet验证了网络深度的增加可提高网络的性能,其核心思想是采用较小的卷积核来增加网络深度,3×3的卷积核是最小的能够捕捉八邻域信息的卷积核,且多个3×3的卷积核比单个大尺寸的卷积核具有更多的非线性函数和更少的参数。因此,VGGNet被广泛的用来提取图像特征。VGG16由16层组成,如图2所示,图中Conv2D代表卷积计算,MaxPooling为最大池化操作,Flatten将计算结果转化为一维向量,Dense为全连接层。VGG16包含13个卷积层和4个最大池化层与3个全连接层,其中每个卷积层采用RELU激活函数,其中每个卷积层采用的都是3×3的卷积核,经历第一个卷积计算后产生64个通道的特征图,随着网络层数的加深,在经历每一次的池化计算后,卷积计算得到的通道数翻倍,直到其通道数达到512后,其余的卷积操作不会再增加特征图的通道数。

图2

2.2 Batch Normalization、ELU与Dropout

因深层神经网络在做非线性变换前的激活函数输入值会随着网络深度加深,或在训练过程中其分布逐渐发生偏移或变动,导致其整体分布向非线性函数取值区间的上下限靠近,从而致使反向传播时低层神经网络的梯度消失。针对该梯度消失问题,批规范化[27](Batch Normalization,简称BN)通过一定的规范化手段,固定每层网络输入特征的均值与方差,可解决梯度弥散,提升训练速度与收敛速度,增加分类效果,较好防止过拟合。

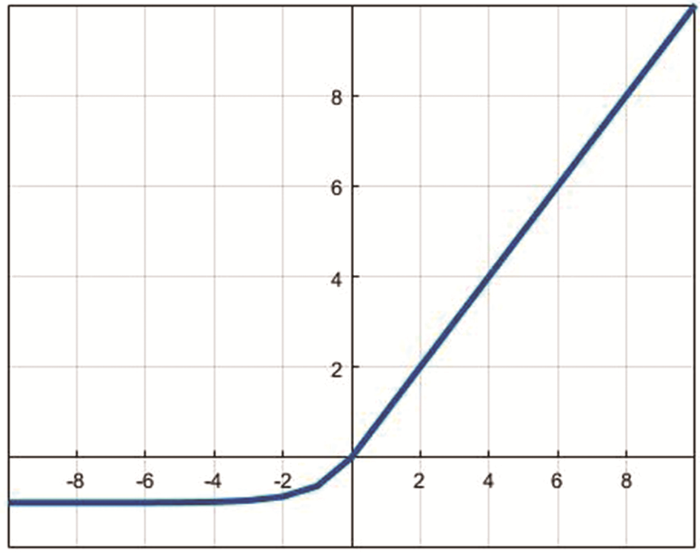

随机失活(Dropout)[28]使某个神经元的激活值以一定的概率p停止工作,降低了网络神经元之间相互复杂的共适应关系,使模型泛化性更强,不太依赖某些局部的特征,从而防止过拟合现象。

图3

2.3 本文实验网络结构

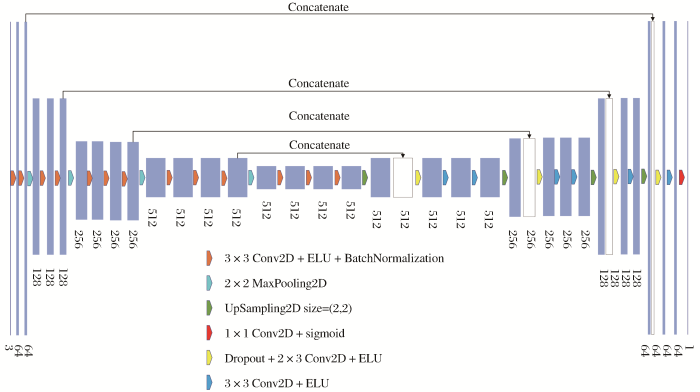

实验网络结构如图4所示,实验将去除全连接层的VGG16网络结构作为U-Net网络的编码器,并在解码路径的每层卷积计算后增加BN,从而达到了增大梯度,提升训练速度与收敛速度,增加分类的效果,防止过拟合。网路的解码路径与其编码路径相对应,使用上采样将特征图像大小扩大至原来两倍,并在上采样计算后,将上采样的计算输出与解码器相对应的输出部分进行串联(Concatenate),最后增加Dropout层,使其不太过于依赖某些局部特征,从而达到防止过拟合的效果,同时采用与其编码路径对应的卷积计算。采用ELU作为所有3×3卷积计算的激活函数,加快实验网络的收敛速度。

图4

3 实验与结果分析

3.1 实验数据

表1 实验参数

Table 1

| 参数名称 | 参数值 |

|---|---|

| 学习率 | 0.000 1 |

| 优化器 | Adam |

| 损失函数 | binary_crossentropy |

| Batchsize | 2 |

| Epochs | 35 |

| Dropout(keep_prob) | 0.5 |

3.2 实验结果分析

为验证本文的道路提取效果,以及数据扩充对实验的影响,采用总体分类精度和Kappa系数来进行精度验证,评价效果。总体分类精度是正确分类的像元个数除以总像元个数,Kappa系数的计算基于混淆矩阵,其数值一般处于[0,1],当Kappa系数位于[0.61,0.80],表示该实验结果与真实值具有高度的一致性,当Kappa系数位于[0.81,1],表示该实验结果与真实值几乎完全一致。

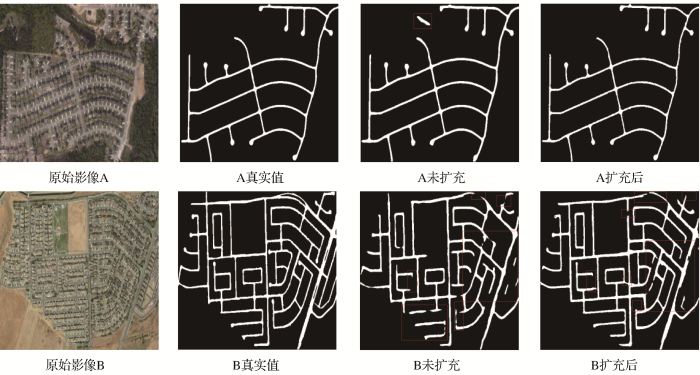

3.2.1 数据扩充前后对比实验

U-Net可以从较小的训练数据集中进行学习,但对于深度学习而言,训练数据集的完整性、准确性与丰富性对实验效果有着较高的影响,丰富且高质量的训练数据可以训练出更好的模型。获取大量的训练数据需要耗费相当大的人力与物力,且某些训练数据获取与制作存在困难,因此需要采用一些方法,对已有的训练数据进行扩充,解决训练数据缺乏的问题,提升模型的泛化性和准确性。其中,对图像采用旋转与镜像的操作,是一种常用的数据扩充方式,扩充后的数据集是同一目标图像在不同角度的视觉表示。

图5

表2 数据扩充前后实验

Table 2

| 区域 | 扩充后 | 未扩充 | ||

|---|---|---|---|---|

| 总体分类精度/% | Kappa系数 | 总体分类精度/% | Kappa系数 | |

| A | 99.13 | 0.94 | 98.40 | 0.89 |

| B | 95.32 | 0.83 | 93.59 | 0.76 |

实验结果表明,数据集扩充后,提取效果有较好的提升。在区域A中,将建筑物误分为道路的区域,在数据扩充后,该区域分类正确;区域B中,数据扩充前对细小道路的提取效果不佳,数据扩充后,断裂部分减少。综上,数据扩充后,实验精度明显提升,该方法的总体分类精度提升1.23%,Kappa系数提升0.06。由此可见,实验数据的合理扩充对实验效果有着较好的提升,可以提升其网络模型的泛化学习能力。

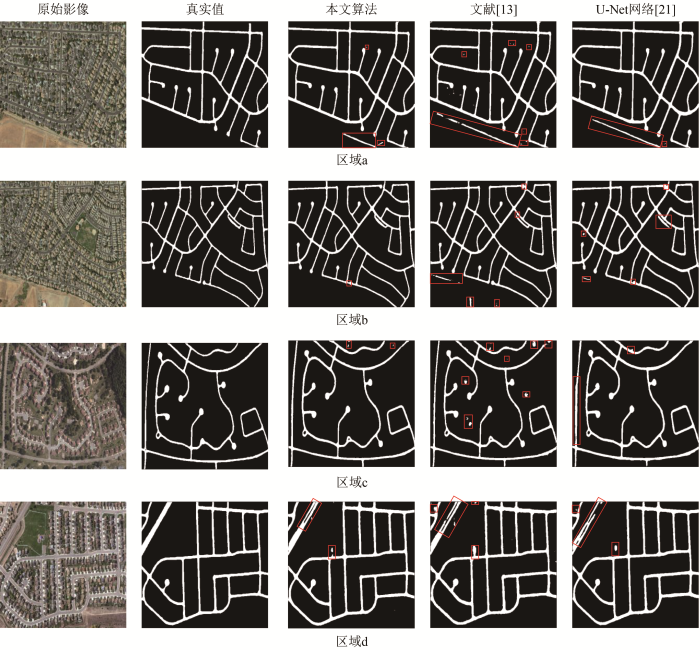

3.2.2 与其他算法对比实验

图6

表3 不同算法对比实验

Table 3

4 结 语

针对现有算法对高分辨率遥感影像的道路信息提取不完整,且存在漏提、错提、断裂等问题,利用U-Net网络较强的图像分割能力,提出了一种改进U-Net的高分辨率影像道路提取方法。该方法将VGG16作为网络编码结构,并在编码路径中添加BN,解码路径添加Dropout层,选用ELU激活函数,较好地解决了神经网络训练中出现的过拟合问题。实验结果表明,数据集的扩充有助于提高道路提取结果的准确度,具体表现在孤立点与断裂部分的减少;此外,该方法可以通过计算机自主学习道路的复杂抽象特征,避免了传统算法人工确定参数造成的主观影响,进一步提高了道路提取的准确度,较好地解决了错提、漏提与道路断裂等问题。该方法的道路提取平均Kappa系数大于0.9,与其他方法相比,道路的提取结构更加完整。

本文方法存在以下几点不足,首先,对建筑密集、阴影及树木遮挡区域的提取效果欠佳;其次,该方法受训练数据集的影响较大,且单一模型提升的精度有限。综上所述,训练数据的有效扩充,探究多模型集成的遥感影像道路提取,将是进一步的研究方向。

参考文献

Automatic Road Detection and Centerline Extraction via Cascaded End-to-End Convolutional Neural Network

[J].

Summary of Road Network Extraction Methods for SAR Images

[J].

SAR图像道路网提取方法综述

[J].

Summary of Road Information Extraction Methods in High-Score Remote Sensing Images

[J].

高分遥感影像中道路信息提取方法综述

[J].

A Review of Road Extraction Methods from Remote Sensing Images

[J].

遥感图像道路提取方法综述

[J].

Hyperspectral Imaging: A Useful Technology for Transportation Analysis

[J].

Research on Road Extraction Method Combining Spectrum and Shape Characteristics

[J].

光谱与形状特征相结合的道路提取方法研究

[J].

Optimized Method for Road Extraction from High Resolution Remote Sensing Image based on Watershed Algorithm

[J].

基于分水岭算法的高分遥感图像道路提取优化方法

[J].

Object-based Road Extraction in Remote Sensing Image Using Markov Random Field

[J].

利用MRF方法的高分辨率影像道路提取

[J].

Region-based Urban Road Extraction from VHR Satellite Images Using Binary Partition Tree

[J].

Fusion of Pixel-based and Object-based Features for Road Centerline Extraction from High-resolution Satellite Imagery

[J].

像元与对象特征融合的高分辨率遥感影像道路中心线提取

[J].

Use of Salient Features for the Design of a Multistage Framework to Extract Roads from High-Resolution Multispectral Satellite Images

[J].

Road Extraction from Remote Sensing Image based on Fully Convolutional Networks

[J].

全卷积神经网络遥感影像道路提取方法

[J].

A Road Extraction Method for Remote Sensing Image based on Encoder-decoder Network

[J].

基于Encoder-Decoder网络的遥感影像道路提取方法

[J].

Semantic Segmentation of Small Objects and Modeling of Uncertainty in Urban Remote Sensing Images Using Deep Convolutional Neural Networks

[C]∥

Fully Convolutional Networks for Building and Road Extraction: Preliminary Results

[C]∥

Classification for High Resolution Remote Sensing Imagery Using a Fully Convolutional Network

[J].

Convolutional Neural Networks for Large-scale Remote-sensing Image Classification

[J].

UFCN: A Fully Convolutional Neural Network for Road Extraction in RGB Imagery Acquired by Remote Sensing from An Unmanned Aerial Vehicle

[J].

Road Extraction by Deep Residual U-net

[J].

An Enhanced Deep Convolutional Encoder-decoder Network for Road Segmentation on Aerial Imagery

[C]∥

U-Net: Convolutional Networks for Biomedical Image Segmentation

[C]∥

Building Segmentation in High Resolution Remote Sensing Image by Deep ResNet

[J] .

深度残差神经网络高分辨率遥感图像建筑物分割

[J].

Comparison Analysis on Wheat Mapping Using Deep Learning Algorithm from Different Satellite Data Source

[J].崔刚

,深度学习对不同分辨率影像冬小麦识别的适用性研究

[J].

Pyramid Scene Parsing Net⁃ work

[C]∥

Road Centerline Extraction via Semisupervised Segmentation and Multidirection Nonmaximum Suppression

[J].

Very Deep Convolutional Networks for Large-scale Image Recognition

[J].

Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift

[J].

Dropout: A Simple Way to Prevent Neural Networks from Overfitting

[J].

Fast and Accurate Deep Network Learning by Exponential Linear Units (ELUs)

[J].